Menguak Rahasia Transformer: Petualangan Token di Jantung AI Modern

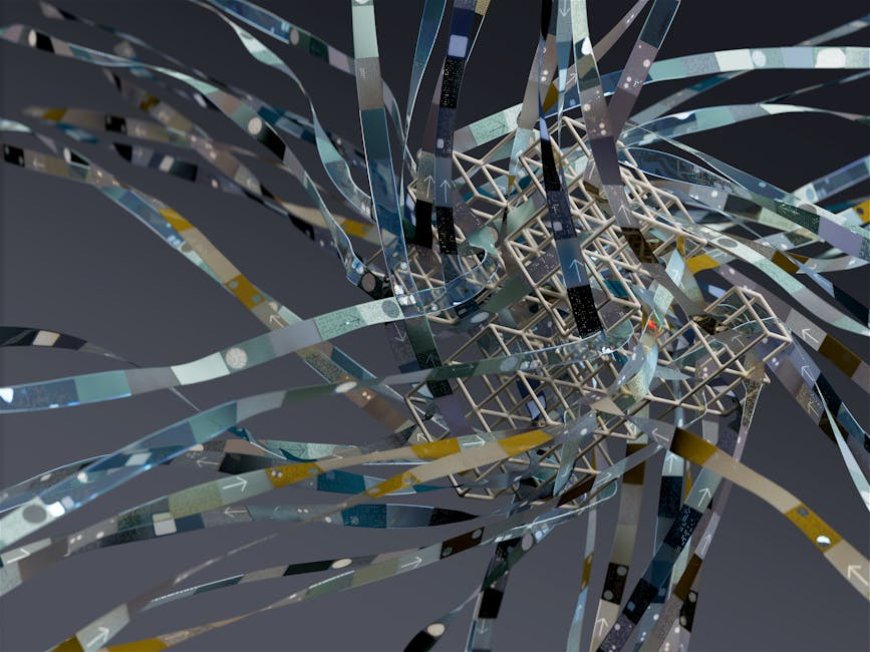

VOXBLICK.COM - Pernahkah kamu bertanya-tanya bagaimana model AI canggih seperti ChatGPT bisa memahami pertanyaanmu, menulis esai, atau bahkan membuat kode? Di balik kemampuan luar biasa itu, ada sebuah arsitektur cerdas yang menjadi tulang punggungnya: Transformer. Ini bukan robot yang berubah bentuk seperti yang ada di film, melainkan sebuah inovasi revolusioner dalam dunia kecerdasan buatan yang mengubah cara kita berinteraksi dengan teknologi.

Artikel ini akan mengajak kamu dalam sebuah petualangan seru, menyelami jantung Transformer.

Kita akan mengikuti perjalanan menakjubkan setiap token data, mulai dari saat ia masuk sebagai bagian dari kalimatmu, hingga menjadi representasi cerdas yang memungkinkan AI "berpikir" dan merespons. Bersiaplah untuk menguak rahasia Transformer dan memahami fondasi di balik AI modern yang telah merevolusi banyak aspek kehidupan kita!

Apa Itu Arsitektur Transformer? Sebuah Revolusi dalam AI

Sebelum Transformer muncul, model-model AI untuk pemrosesan bahasa alami (NLP) seperti Recurrent Neural Networks (RNN) dan Long Short-Term Memory (LSTM) berjuang dengan data sekuensial yang panjang.

Mereka memproses kata satu per satu, yang membuat mereka lambat dan sering melupakan konteks awal kalimat yang panjang. Transformer, diperkenalkan oleh Google dalam makalah "Attention Is All You Need" pada tahun 2017, mengubah segalanya.

Alih-alih memproses secara berurutan, Transformer memperkenalkan mekanisme Self-Attention yang memungkinkan model melihat semua kata dalam sebuah kalimat secara bersamaan.

Ini seperti memiliki pandangan mata burung yang bisa melihat semua bagian dari sebuah teka-teki sekaligus, bukan hanya satu per satu. Hasilnya? Pemrosesan yang jauh lebih cepat, kemampuan memahami konteks yang lebih baik, dan performa yang tak tertandingi dalam berbagai tugas NLP, termasuk yang kita lihat pada model-model bahasa besar (LLM) seperti ChatGPT.

Petualangan Token Dimulai: Dari Teks Menjadi Vektor

Setiap kali kamu mengetik sesuatu ke dalam ChatGPT, kata-kata atau bahkan bagian dari kata-kata itu tidak langsung dipahami oleh mesin. Mereka harus melalui proses yang disebut tokenisasi.

Misalnya, kalimat "Saya suka AI" bisa dipecah menjadi token-token seperti "Saya", "suka", dan "AI". Beberapa token bisa juga berupa bagian dari kata atau bahkan tanda baca.

Setelah dipecah, setiap token diubah menjadi angka unik, lalu diwakili sebagai sebuah embedding.

Bayangkan embedding ini sebagai sebuah "sidik jari" numerik yang kaya informasi, menempatkan token tersebut dalam ruang multidimensi di mana kata-kata dengan makna serupa berada dekat satu sama lain. Inilah langkah pertama token kita dalam perjalanan memahami dunia, mengubah teks yang tidak terstruktur menjadi format yang bisa diolah oleh arsitektur Transformer.

Jantung Transformer: Mekanisme Self-Attention

Inilah bagian paling ajaib dari Transformer dan kunci kemampuannya dalam memahami konteks.

Mekanisme Self-Attention memungkinkan setiap token dalam kalimat untuk "memperhatikan" token-token lain dalam kalimat yang sama dan menilai seberapa relevan mereka satu sama lain. Bagaimana cara kerjanya?

Setiap token menghasilkan tiga vektor berbeda:

- Query (Q): Ini seperti pertanyaan yang diajukan token tentang token lain. "Seberapa relevan kamu denganku?"

- Key (K): Ini seperti label atau informasi yang dimiliki setiap token. "Inilah aku dan apa yang kuwakili."

- Value (V): Ini adalah representasi sebenarnya dari token yang akan digunakan setelah relevansi ditentukan.

Model kemudian menghitung skor relevansi antara Query dari satu token dengan Key dari semua token lainnya.

Skor ini kemudian digunakan untuk secara cerdas "menimbang" Value dari setiap token, menghasilkan representasi baru yang telah diperkaya dengan konteks dari seluruh kalimat. Ini memungkinkan kata seperti "bank" untuk dipahami konteksnya, apakah itu "bank sungai" atau "bank uang", berdasarkan kata-kata di sekitarnya yang mendapatkan perhatian lebih.

Multi-Head Attention: Melihat dari Berbagai Sudut

Satu mekanisme Self-Attention memang hebat, tapi Transformer tidak hanya berhenti di satu. Ia menggunakan beberapa "kepala" perhatian (Multi-Head Attention) yang bekerja secara paralel.

Bayangkan kamu memiliki beberapa ahli yang menganalisis sebuah masalah dari sudut pandang yang berbeda-beda. Setiap ahli menyoroti aspek yang berbeda dan kemudian menggabungkan temuannya untuk mendapatkan pemahaman yang lebih lengkap.

Setiap kepala perhatian fokus pada aspek hubungan yang berbeda antar token. Misalnya, satu kepala mungkin fokus pada hubungan sintaksis (struktur kalimat), sementara kepala lain fokus pada hubungan semantik (makna kata).

Hasil dari semua kepala ini kemudian digabungkan untuk menciptakan pemahaman yang lebih kaya, komprehensif, dan kuat tentang kalimat, yang sangat krusial untuk kecerdasan buatan yang kompleks.

Feed-Forward Networks dan Normalisasi: Memproses Lebih Lanjut

Setelah melewati lapisan Multi-Head Attention, representasi token yang sudah diperkaya konteks ini kemudian melewati Feed-Forward Network (FFN).

Ini adalah jaringan saraf sederhana yang diterapkan secara independen pada setiap posisi token. Tugasnya adalah memproses lebih lanjut informasi yang telah dikumpulkan dan mengekstrak fitur-fitur yang lebih tinggi, memberikan model kemampuan untuk memodelkan hubungan non-linear yang kompleks.

Sepanjang perjalanan ini, ada juga teknik seperti Residual Connections dan Layer Normalization.

Residual Connections membantu informasi mengalir dengan lancar melalui lapisan-lapisan yang dalam, mencegah masalah "vanishing gradient" dan memastikan model dapat belajar secara efektif bahkan dengan arsitektur yang sangat dalam. Layer Normalization membantu menstabilkan proses pelatihan, memastikan setiap lapisan menerima input dengan distribusi yang serupa, yang sangat penting untuk stabilitas dan kecepatan pembelajaran AI modern.

Positional Encoding: Menjaga Urutan Waktu Tanpa Urutan

Karena Transformer memproses semua token secara paralel dan tidak secara berurutan seperti RNN, ia tidak secara inheren tahu urutan kata dalam kalimat. Di sinilah Positional Encoding berperan.

Ini adalah vektor numerik yang ditambahkan ke embedding setiap token di awal proses, memberikan informasi tentang posisi relatif token tersebut dalam urutan. Dengan demikian, model tahu bahwa "kucing mengejar tikus" berbeda dengan "tikus mengejar kucing", meskipun kata-katanya sama persis. Ini adalah detail cerdas yang memungkinkan Transformer memahami sintaksis kalimat.

Dari Representasi ke Prediksi: Output Layer

Setelah token kita melewati semua lapisan Encoder (jika itu adalah Transformer Encoder-Decoder) atau hanya Decoder (jika itu adalah model generatif seperti GPT), representasi cerdasnya siap untuk digunakan.

Pada tahap akhir, representasi ini masuk ke Output Layer. Di sini, model memprediksi token berikutnya dalam urutan, atau melakukan tugas lain seperti klasifikasi atau terjemahan.

Untuk model seperti ChatGPT, output layer ini akan menghasilkan distribusi probabilitas untuk setiap kata yang mungkin ada dalam kosakata.

Model kemudian memilih kata dengan probabilitas tertinggi, dan proses ini berulang untuk menghasilkan kalimat demi kalimat, menciptakan respons yang koheren, relevan, dan seringkali sangat manusiawi. Ini adalah puncak dari petualangan token, di mana representasi internal diubah kembali menjadi bahasa yang bisa kita pahami.

Mengapa Arsitektur Transformer Begitu Revolusioner?

Keberhasilan Transformer bukan hanya kebetulan, melainkan hasil dari beberapa inovasi fundamental. Ada beberapa alasan utama mengapa arsitektur ini mendominasi dunia kecerdasan buatan saat ini:

- Paralelisasi: Kemampuan memproses semua token sekaligus memungkinkan pelatihan yang jauh lebih cepat pada perangkat keras modern (GPU), dibandingkan dengan model sekuensial yang harus menunggu setiap langkah selesai.

- Memahami Konteks Jarak Jauh: Mekanisme Self-Attention memungkinkan model untuk dengan mudah menghubungkan kata-kata yang jauh dalam sebuah kalimat atau dokumen, mengatasi batasan memori yang dimiliki oleh RNN dan LSTM.

- Kemampuan Skala: Arsitektur Transformer dapat diskalakan menjadi model yang sangat besar dengan miliaran parameter, seperti GPT-3 atau GPT-4, yang menghasilkan kemampuan generatif dan pemahaman bahasa yang luar biasa.

- Fleksibilitas: Arsitektur dasar Transformer dapat diadaptasi untuk berbagai tugas, mulai dari terjemahan mesin, ringkasan teks, hingga pembuatan gambar (seperti dalam Stable Diffusion, yang juga menggunakan prinsip Attention untuk memproses informasi visual).

Jadi, setiap kali kamu berinteraksi dengan AI modern, ingatlah petualangan token yang tak terlihat ini.

Dari input teks sederhana, token-token itu melalui serangkaian transformasi cerdas, berinteraksi satu sama lain melalui perhatian, dan akhirnya muncul sebagai respons yang kamu lihat. Ini adalah bukti kecanggihan arsitektur Transformer yang terus mendorong batas-batas apa yang mungkin dilakukan oleh mesin.

Mempelajari cara kerja Transformer tidak hanya membuka wawasan tentang teknologi di balik layar, tetapi juga menunjukkan betapa jauhnya kita telah melangkah dalam upaya menciptakan kecerdasan buatan yang semakin intuitif dan

bermanfaat. Semoga artikel ini menginspirasimu untuk terus menjelajahi dunia AI yang menakjubkan ini!

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)