Apakah Data Center AI Membuat Tagihan Listrik Melonjak Tajam

VOXBLICK.COM - Bayangkan ruangan penuh dengan server bertenaga tinggi, lampu LED yang berkedip tanpa henti, dan suhu ruangan yang dijaga tetap dingin 24 jam non-stop. Itulah gambaran data center AI modernjantung dari inovasi gadget, cloud computing, hingga aplikasi kecerdasan buatan yang kini semakin merasuki kehidupan sehari-hari. Namun, di balik kemajuan luar biasa ini, muncul pertanyaan besar: apakah data center AI benar-benar menyebabkan lonjakan tajam pada tagihan listrik?

Baru-baru ini, sejumlah senator Amerika mulai menyoroti konsumsi energi data center yang melayani AI generatif seperti ChatGPT, Google Gemini, dan layanan cloud berbasis AI lainnya.

Mereka mengkhawatirkan dampak ekologis sekaligus membandingkan efisiensi teknologi baru ini dengan generasi sebelumnya. Lantas, bagaimana sebenarnya teknologi AI di data center bekerja, seberapa besar konsumsi energinya, dan apa saja plus minusnya dibanding teknologi lama?

Teknologi AI di Data Center: Apa yang Berubah?

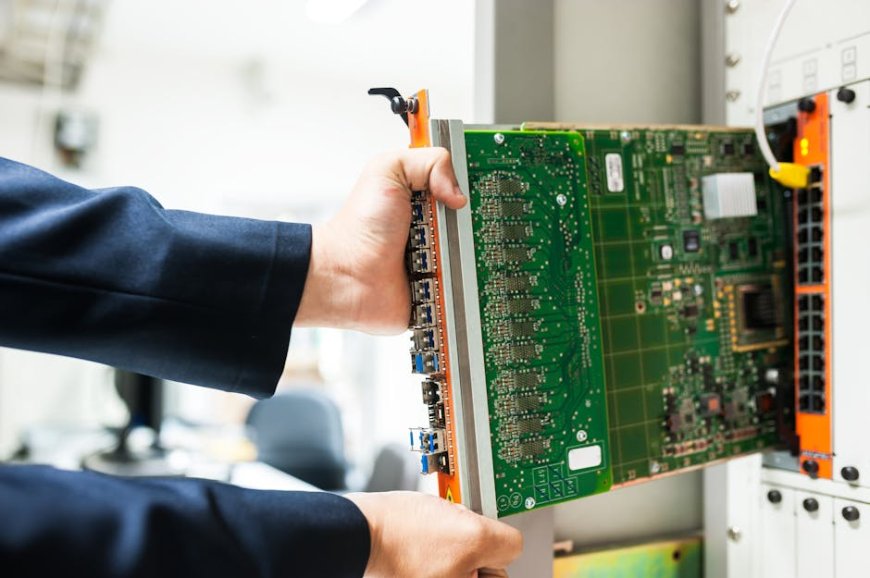

Pertama, mari bongkar dapur teknologi di balik data center AI.

Dibandingkan dengan generasi sebelumnya yang lebih banyak mengandalkan CPU, data center AI modern kini didominasi oleh GPU (Graphics Processing Unit) dan chip khusus seperti Nvidia H100, Google TPU, dan AMD Instinct MI300. Prosesor-prosesor ini dirancang untuk mengolah jutaan kalkulasi paralel secara simultansangat cocok untuk pelatihan dan inferensi model AI raksasa.

- Nvidia H100: 80 miliar transistor, TDP hingga 700W per chip, performa hingga 4x lebih tinggi dari generasi A100.

- Google TPU v5e: Dirancang khusus untuk AI dengan efisiensi daya lebih baik per operasi AI dibandingkan CPU konvensional.

- AMD Instinct MI300: Menggunakan teknologi multi-chiplet dan memori HBM3, menawarkan bandwidth tinggi dengan efisiensi energi lebih baik.

Dengan lompatan performa ini, model-model AI seperti GPT-4, Llama 3, dan Gemini Ultra kini bisa dilatih dan dijalankan jauh lebih cepat.

Namun, setiap chip generasi baru juga membutuhkan daya listrik yang jauh lebih besar per unit, memicu kekhawatiran akan konsumsi listrik yang meroket.

Fakta Konsumsi Energi Data Center AI

Menurut laporan International Energy Agency (IEA), konsumsi listrik global oleh data centertermasuk AImencapai sekitar 460 terawatt jam (TWh) pada tahun 2022. Jumlah itu setara dengan gabungan konsumsi listrik negara-negara kecil seperti Swedia dan

Norwegia! Sementara itu, satu pusat data AI berskala hyperscale (seperti milik Microsoft, Google, atau Amazon) bisa mengkonsumsi listrik hingga 100 megawattcukup untuk menyalakan lebih dari 80.000 rumah tangga.

Lonjakan permintaan ini didorong oleh:

- Pelatihan model AI generatif yang memakan waktu berminggu-minggu dan memerlukan ribuan GPU.

- Proses inferensi real-time untuk layanan seperti ChatGPT dan fitur AI di gadget modern, yang terus berjalan 24/7.

- Kebutuhan pendinginan ekstra karena panas yang dihasilkan perangkat keras AI sangat tinggi.

Perbandingan Efisiensi: AI vs. Generasi Sebelumnya

Menariknya, walaupun konsumsi listrik tiap chip AI lebih tinggi, jika dilihat dari sisi efisiensi per satuan pekerjaan, teknologi baru ini menawarkan peningkatan signifikan. Berikut beberapa perbandingan:

- GPU Nvidia H100 menawarkan performa AI 4x lebih tinggi per watt dibandingkan A100 generasi sebelumnya.

- Google TPU v5e diklaim 2,5x lebih efisien dalam inferensi AI dibandingkan TPU v4.

- AMD Instinct MI300 mengurangi konsumsi energi hingga 40% untuk beban kerja AI berat dibandingkan arsitektur lama.

Namun, karena permintaan total pekerjaan AI melonjak drastis, konsumsi listrik secara agregat tetap meningkat pesat.

Kelebihan dan Kekurangan Data Center AI Modern

- Kelebihan:

- Memungkinkan gadget dan aplikasi menawarkan fitur AI canggih secara real-time (misal, kamera smartphone dengan deteksi objek berbasis AI, asisten digital, hingga fitur pengeditan otomatis).

- Peningkatan efisiensi per operasi AI, memungkinkan tugas berat diselesaikan lebih cepat.

- Dukungan inovasi di berbagai bidang: kesehatan, transportasi, hiburan, dan pendidikan.

- Kekurangan:

- Meningkatkan kebutuhan listrik global, berpotensi memperbesar jejak karbon jika tidak diimbangi energi terbarukan.

- Biaya operasional data center melonjak, bisa berdampak pada harga layanan dan gadget AI di masa depan.

- Tantangan dalam sistem pendinginan yang lebih kompleks dan mahal.

Inovasi Menuju Energi Lebih Hijau

Untuk mengatasi tantangan konsumsi listrik, produsen chip dan operator data center berlomba mengembangkan solusi hemat energi.

Mulai dari desain chip berbasis proses 5nm atau lebih kecil, sistem pendinginan cair (liquid cooling), hingga pemanfaatan energi terbarukan seperti tenaga surya dan angin. Bahkan, beberapa data center baru di Eropa dan Amerika sudah beroperasi 100% dengan energi hijau.

Penutup: Menuju Era AI yang Ramah Energi

Teknologi AI di data center memang membawa lonjakan konsumsi listrik, namun juga menghadirkan lompatan besar dalam efisiensi dan inovasi di dunia gadget serta aplikasi modern.

Tantangan utamanya kini adalah menyeimbangkan kebutuhan komputasi yang terus meningkat dengan solusi energi yang berkelanjutan, agar masa depan AI tak hanya canggih, tapi juga ramah lingkungan dan ekonomis.

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)