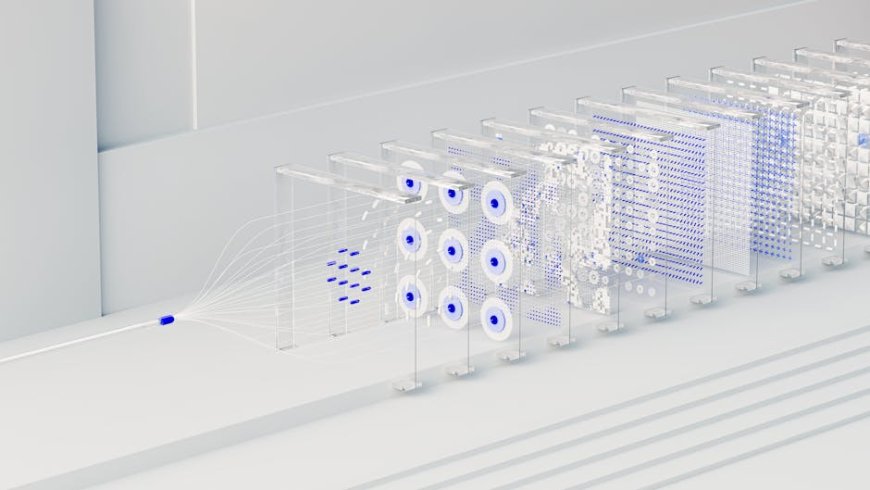

Cara Mudah Melatih Model AI di Banyak GPU Sekaligus

VOXBLICK.COM - Pelatihan model AI, khususnya deep learning, memang sering jadi tantangan tersendiri. Prosesnya bisa sangat memakan waktu, apalagi jika data yang kamu olah sangat besar atau modelnya kompleks. Tapi tahukah kamu, kamu bisa mempercepat workflow deep learning dengan membagi beban kerja ke banyak GPU sekaligus? Ini bukan cuma soal punya perangkat canggih, tapi juga soal strategi yang tepat agar semua GPU kamu bekerja maksimal tanpa ribet.

Banyak praktisi AI, baik pemula maupun yang sudah berpengalaman, mencari cara paling efisien untuk melakukan training model AI di beberapa GPU.

Selain mempercepat eksperimen, pendekatan ini juga bikin kamu lebih produktif dan hasil pelatihan model bisa lebih optimal. Yuk, simak panduan berikut agar kamu bisa segera menerapkannya di project AI-mu!

Kenapa Perlu Melatih Model AI di Banyak GPU?

Memanfaatkan banyak GPU pada saat training model AI punya banyak keunggulan. Berikut beberapa alasannya:

- Waktu training lebih singkat. Proses pelatihan bisa dipercepat hingga beberapa kali lipat.

- Skalabilitas lebih baik. Model dan data yang lebih besar bisa dilatih tanpa khawatir kehabisan memori.

- Eksperimen lebih banyak. Kamu bisa mencoba berbagai parameter atau arsitektur model dengan lebih cepat.

Langkah Mudah Melatih Model AI di Banyak GPU

Agar kamu tidak bingung, berikut panduan praktis membagi beban pelatihan model AI ke beberapa GPU. Panduan ini bisa langsung kamu terapkan, baik menggunakan framework seperti PyTorch maupun TensorFlow.

-

Cek dan Siapkan GPU

Pastikan komputer atau server kamu memang sudah punya lebih dari satu GPU. Kamu bisa mengeceknya dengan perintah sepertinvidia-smidi terminal. Usahakan driver dan CUDA Toolkit kamu sudah versi terbaru agar kompatibel dengan framework yang digunakan. -

Pakai Data Parallelism

Cara paling populer dan mudah adalah dengan data parallelism. Artinya, data training kamu akan dibagi ke beberapa GPU, lalu hasilnya digabungkan lagi di akhir setiap batch.- Di PyTorch, kamu bisa gunakan

torch.nn.DataParallelatautorch.nn.parallel.DistributedDataParallel. - Di TensorFlow, gunakan

tf.distribute.MirroredStrategy()untuk paralel training di satu mesin dengan banyak GPU.

- Di PyTorch, kamu bisa gunakan

-

Atur Batch Size dan Pembagian Data

Agar tiap GPU bekerja optimal, sebaiknya batch size kamu disesuaikan dengan jumlah GPU. Misal, ingin batch size total 128 dan punya 4 GPU? Setiap GPU dapat 32 data per batch. -

Mulai Training Seperti Biasa

Framework AI akan otomatis membagikan model dan data ke GPU yang tersedia. Kamu cukup mengatur parameter yang sesuai, lalu jalankan training seperti biasa. -

Monitoring dan Troubleshooting

Pantau penggunaan GPU lewatnvidia-smiatau tools monitoring lain. Kalau ada GPU yang idle, cek lagi script training-mu, bisa jadi ada kesalahan pada pembagian data atau konfigurasi device.

Tips Praktis Agar Workflow Deep Learning Lebih Lancar

- Selalu backup script dan data sebelum memulai training multi-GPU, untuk menghindari kehilangan progres karena error.

- Gunakan library open source seperti

Horovodjika ingin training di banyak mesin sekaligus (bukan hanya banyak GPU di satu mesin). - Optimalkan pemakaian memori GPU dengan mengatur mixed precision training agar proses lebih efisien.

- Update framework secara berkala, karena fitur multi-GPU biasanya terus disempurnakan oleh pengembang.

- Bergabung dengan komunitas seperti forum PyTorch, TensorFlow, atau Discord AI untuk saling berbagi pengalaman.

Inspirasi: Semakin Banyak GPU, Semakin Produktif

Membagi proses pelatihan model AI ke banyak GPU memang terdengar teknis, tapi sebenarnya bisa jadi kebiasaan baik yang mempercepat workflow kamu sehari-hari.

Dengan persiapan yang matang, script yang rapi, serta monitoring yang baik, kamu bisa menikmati hasil training yang lebih cepat dan efisien. Jadi, jangan ragu mencoba tips-tips di atas, siapa tahu produktivitas dan hasil eksperimen AI-mu melonjak jauh lebih tinggi!

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)