China Curiga AI OpenClaw PNS Dilarang Install Apa Dampaknya

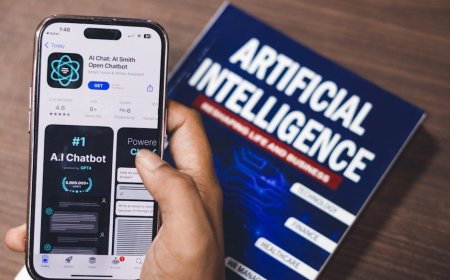

VOXBLICK.COM - Kabar bahwa China curiga terhadap AI OpenClaw hingga akhirnya melarang PNS memasangnya langsung memicu diskusi luas: apakah ini murni soal keamanan siber, privasi warga, atau ada kekhawatiran lain yang lebih strategis. Di satu sisi, AI memang bisa mempercepat layanan publik, analitik kebijakan, dan otomasi administrasi. Namun di sisi lain, setiap sistem AIterutama yang terhubung ke databisa menjadi “pintu” baru bagi risiko kebocoran, penyalahgunaan, atau bahkan manipulasi.

Artikel ini akan membedah alasan kehati-hatian pemerintah, dampak nyata larangan tersebut, serta pelajaran penting untuk organisasi lain yang ingin menerapkan AI secara bertanggung jawab.

Kamu akan mendapat gambaran praktis: apa yang perlu dicek, bagaimana mengurangi risiko, dan bagaimana membangun tata kelola AI yang lebih aman.

Kenapa China Bisa Curiga pada AI OpenClaw?

Ketika pemerintah mulai curiga pada sebuah teknologi AI, biasanya bukan karena “AI itu jahat”, melainkan karena cara teknologi itu dipakai dan apa yang ia akses. Dalam kasus AI OpenClaw, kecurigaan dapat muncul dari beberapa aspek berikut:

- Potensi akses ke data sensitif: AI yang digunakan oleh PNS berpotensi terhubung dengan data administrasi, identitas, atau dokumen internal. Jika sistem tidak transparan, sulit memastikan data tidak “mengalir” ke tempat yang tidak diinginkan.

- Ketidakjelasan sumber model dan pelatihan: Pemerintah biasanya ingin tahu model dilatih dengan data apa, bagaimana parameter diperbarui, dan apakah ada mekanisme untuk mencegah bias atau manipulasi.

- Risiko “supply chain” perangkat lunak: Aplikasi/komponen AI bisa saja memiliki dependensi pihak ketiga. Jika ada celah di salah satu komponen, dampaknya bisa luas.

- Over-permission saat instalasi: Kadang aplikasi AI meminta izin yang lebih besar dari kebutuhan, misalnya akses ke file, jaringan, clipboard, atau metadata perangkat.

- Kesulitan audit dan verifikasi: Jika algoritma bersifat tertutup (black-box), organisasi sulit melakukan pengujian independen terhadap perilaku model.

Intinya, larangan bukan berarti AI otomatis berbahaya. Tapi ketika ada ketidakpastian terkait keamanan, privasi, dan kontrol, pemerintah cenderung memilih pendekatan “mencegah lebih awal”.

PNS Dilarang Install: Apa yang Sebenarnya Dikhawatirkan?

Larangan PNS untuk menginstal AI OpenClaw biasanya berkaitan dengan tiga lapisan risiko: keamanan informasi, privasi, dan kepatuhan kebijakan. Mari kita uraikan secara lebih konkret.

1) Keamanan siber: potensi kebocoran atau akses tidak sah

AI yang berjalan di perangkat kantor bisa menjadi target serangan. Contohnya, malware bisa menyamar sebagai plugin AI, atau ada skenario di mana data yang diproses oleh AI kemudian dikirim ke server tanpa kontrol yang memadai.

Pemerintah biasanya ingin memastikan:

- tidak ada pengiriman data ke domain yang tidak disetujui,

- tidak ada proses yang berjalan diam-diam di latar belakang,

- tidak ada celah autentikasi atau token yang mudah dicuri,

- tidak ada risiko eskalasi hak akses.

2) Privasi warga: data pribadi bisa terseret proses AI

Dalam layanan publik, data yang dipakai sering kali sensitif: nomor identitas, riwayat layanan, alamat, sampai dokumen administratif.

Jika AI digunakan untuk ringkasan dokumen, klasifikasi, atau pencarian informasi, ada kemungkinan data pribadi ikut diproses. Tanpa kebijakan yang jelas, privasi bisa terancam.

Selain itu, ada pula risiko “data retention” (penyimpanan ulang) oleh sistemmisalnya jawaban atau prompt pengguna tersimpan untuk pelatihan atau analitik tanpa persetujuan yang memadai.

3) Kepatuhan dan akuntabilitas: siapa bertanggung jawab?

Di organisasi pemerintah, setiap alat harus bisa dipertanggungjawabkan. Jika AI memunculkan rekomendasi atau output yang keliru, perlu diketahui:

- bagaimana model bekerja,

- parameter apa yang dipakai,

- apakah ada jejak audit (audit trail),

- bagaimana proses koreksi dan validasi dilakukan.

Jika AI OpenClaw tidak memenuhi standar auditability, larangan menjadi langkah akuntabilitas.

Dampak Larangan: Efek Jangka Pendek dan Jangka Panjang

Larangan seperti ini tidak hanya berdampak pada satu aplikasi. Dampaknya merambat ke cara instansi merencanakan adopsi AI. Berikut gambaran dampak yang mungkin terjadi.

Dampak jangka pendek

- Gangguan produktivitas sementara: tim yang sudah terlanjur mencoba AI untuk tugas tertentu mungkin harus menghentikan penggunaannya.

- Perubahan SOP penggunaan AI: instansi biasanya segera memperketat aturan instalasi, akses jaringan, dan penggunaan tool AI.

- Audit sistem internal meningkat: perangkat, aplikasi, dan log komunikasi bisa diperiksa untuk memastikan tidak ada penggunaan yang melanggar.

- Penundaan proyek AI: karena butuh evaluasi ulang terhadap risiko dan kelayakan.

Dampak jangka panjang

- Standar tata kelola AI semakin ketat: organisasi cenderung mengadopsi kerangka governance, misalnya penilaian risiko sebelum implementasi.

- Preferensi pada AI yang dapat diaudit: model yang transparan, bisa dipantau, dan memiliki kontrol data lebih mungkin dipilih.

- Peralihan ke solusi dalam negeri atau deployment terkontrol: untuk mengurangi ketergantungan pada sistem yang sulit diverifikasi.

- Budaya “privacy by design”: AI akan dirancang agar meminimalkan data sensitif, memperkecil jejak, dan memperjelas tujuan penggunaan.

Dengan kata lain, larangan tersebut bisa mengubah arah implementasi AI: dari sekadar “coba dulu” menjadi “uji dulu, audit dulu, baru pakai”.

Pelajaran Penting untuk Organisasi Lain yang Ingin Pakai AI

Kabar ini relevan bukan hanya untuk China atau PNS. Banyak organisasiperusahaan, lembaga pendidikan, layanan kesehatan, hingga startupmenghadapi pertanyaan yang sama: bagaimana memakai AI tanpa mengorbankan keamanan dan privasi?

Berikut langkah praktis yang bisa kamu terapkan agar adopsi AI lebih bertanggung jawab:

- Lakukan penilaian risiko sebelum instalasi

Buat checklist: data apa yang akan diproses, siapa yang mengakses, dan ke mana data dikirim. - Batasi akses dan izin aplikasi

Prinsipnya “least privilege”: berikan izin minimum yang dibutuhkan. Matikan akses yang tidak relevan (misalnya akses file jika tidak perlu). - Pastikan ada kebijakan data yang jelas

Minta kejelasan: apakah prompt dan output disimpan? berapa lama? digunakan untuk pelatihan? Bisa dihapus? - Gunakan lingkungan terkontrol (misalnya sandbox)

Uji AI pada data sintetis atau data yang sudah dianonimkan sebelum menyentuh data operasional. - Wajibkan audit trail dan logging

Organisasi perlu jejak aktivitas: kapan digunakan, oleh siapa, untuk tugas apa, dan bagaimana output dihasilkan. - Lakukan pengujian kualitas dan bias

Selain keamanan, output AI harus diuji agar tidak mengarah pada keputusan yang diskriminatif atau menyesatkan. - Latih pengguna (human-in-the-loop)

Kamu perlu membiasakan tim untuk memverifikasi output, tidak langsung menerima jawaban mentah, dan memahami batasan AI.

Bagaimana Menyusun Kebijakan AI yang Lebih Aman?

Jika kamu memimpin tim teknologi atau kebijakan di organisasi, kamu bisa mulai dari kerangka sederhana namun efektif:

- Klasifikasi data: pisahkan data publik, internal, rahasia, dan sangat sensitif.

- Aturan penggunaan AI per kelas data: misalnya AI tidak boleh dipakai untuk kelas data sensitif tanpa persetujuan khusus.

- Proses approval vendor: sebelum mengizinkan AI, lakukan evaluasi keamanan, privasi, dan kepatuhan.

- Rencana respons insiden: tentukan langkah jika terjadi kebocoran, termasuk cara menghentikan sistem dan melakukan investigasi.

Dengan pendekatan ini, organisasi tidak hanya “melarang” atau “membolehkan”, tetapi mengelola risiko secara terukur.

Refleksi: Kecepatan Adopsi AI Perlu Sejalan dengan Kontrol

Kisah China curiga pada AI OpenClaw hingga melarang PNS memasangnya mengingatkan bahwa adopsi AI bukan sekadar soal fitur canggih.

Yang menentukan adalah keamanan, privasi, dan kemampuan auditterutama saat AI menyentuh data pemerintah dan layanan publik.

Bagi organisasi lain, pesan utamanya jelas: jangan menunggu insiden baru untuk bertindak. Mulailah dengan evaluasi risiko, kontrol akses, kebijakan data, dan pelatihan pengguna.

Kalau AI dipakai dengan tata kelola yang kuat, manfaatnya bisa maksimal tanpa mengorbankan kepercayaan publik.

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)