AI Grids untuk Optimasi Inference di Jaringan Terdistribusi

VOXBLICK.COM - Kalau kamu pernah bertanya-tanya kenapa AI bisa terasa “instan” di satu aplikasi, tapi jadi lambat atau mahal di aplikasi lain, jawabannya sering ada di inference. Inference adalah fase saat model AI benar-benar dipakai untuk menghasilkan jawabanmisalnya menjawab chat, merangkum dokumen, menganalisis gambar, atau menjalankan kemampuan agentic yang bisa mengambil keputusan. Nah, agar inference bisa cepat, hemat, dan tetap andal saat permintaan naik-turun, banyak perusahaan mulai membangun AI grids: jaringan terdistribusi yang mengatur komputasi AI secara cerdas, mirip seperti “listrik yang didistribusikan” untuk kebutuhan komputasi.

Dalam praktiknya, NVIDIA dan para pemimpin operator telekomunikasi menggabungkan infrastruktur jaringan, orkestrasi komputasi, dan optimasi model agar inference berjalan efisien di berbagai lokasi (misalnya edge dan cloud).

Hasilnya: layanan generative dan agentic AI bisa lebih konsisten, dengan latensi lebih rendah serta pemanfaatan sumber daya yang lebih optimal.

Mengapa inference butuh optimasi di jaringan terdistribusi?

Model AI modernterutama yang generatifmemiliki kebutuhan komputasi yang besar.

Tapi masalahnya bukan cuma “berapa cepat GPU”, melainkan juga bagaimana permintaan diproses secara end-to-end: mulai dari pengguna mengirim prompt, sistem memilih lokasi komputasi, menjalankan model, hingga mengembalikan output.

Di jaringan terdistribusi, kamu menghadapi tantangan seperti:

- Latensi jaringan: semakin jauh lokasi server dari pengguna, semakin tinggi waktu respon.

- Variabilitas beban: jam sibuk dan event besar bisa membuat load melonjak.

- Biaya komputasi: menjalankan inference di satu tempat saja bisa mahal atau tidak efisien.

- Keandalan: kegagalan satu node atau kemacetan jaringan bisa mengganggu layanan.

Di sinilah AI grids berperan. Mereka dirancang untuk mengatur “di mana” dan “bagaimana” inference dijalankan, sambil tetap menjaga kualitas layanan.

AI grids itu apa, dan cara kerjanya secara konsep

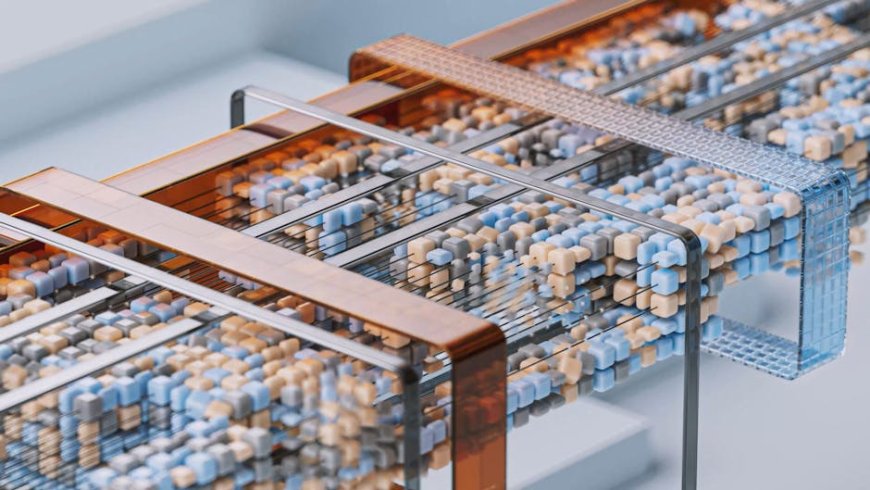

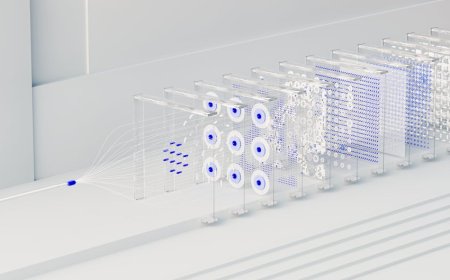

Bayangkan AI grid sebagai kumpulan sumber daya komputasi (GPU/accelerator, memori, dan layanan runtime) yang tersebar di banyak titikmisalnya di pusat data, edge site, atau fasilitas operator telekomunikasi.

Grid ini tidak hanya menghubungkan perangkat, tapi juga mengelola:

- Orkestrasi workload: menentukan penempatan tugas inference berdasarkan kebutuhan.

- Penjadwalan dinamis: menyeimbangkan beban saat trafik berubah.

- Manajemen model: memindahkan atau menyiapkan model versi tertentu sesuai kondisi.

- Optimasi jalur data: mengurangi bottleneck komunikasi antara komponen.

- Observabilitas: memantau latensi, throughput, dan metrik kualitas.

Dengan pendekatan ini, inference tidak lagi “dipaksa” selalu berjalan di satu cluster. Sistem bisa memilih lokasi paling cocok agar generative AI dan agentic AI tetap responsif.

Peran NVIDIA dalam ekosistem optimasi inference

NVIDIA dikenal kuat di sisi akselerasi AI, baik dari sisi hardware maupun software. Namun yang menarik adalah bagaimana teknologi tersebut dipadukan dengan kebutuhan jaringan. Dalam konteks AI grids, fokusnya biasanya pada:

- Performa inference: meningkatkan throughput dan menurunkan waktu eksekusi per token (untuk model generatif).

- Efisiensi energi dan biaya: memaksimalkan pemanfaatan GPU agar tidak ada idle yang berlebihan.

- Skalabilitas: mendukung penambahan node tanpa mengorbankan konsistensi performa.

- Integrasi dengan orkestrasi: supaya runtime inference bisa berjalan mulus pada infrastruktur terdistribusi.

Ketika operator telekomunikasi ikut terlibat, mereka membawa keunggulan jaringan: kapasitas, routing, dan kemampuan menempatkan compute lebih dekat ke pengguna.

Kombinasi ini membuat optimasi inference lebih “nyata”, bukan sekadar klaim performa di satu lab.

Bagaimana AI grids membantu generative dan agentic AI

Generative AI (misalnya LLM) menghasilkan output secara bertahap (token demi token). Itu berarti performa tidak hanya dinilai dari “waktu sampai jawaban pertama”, tapi juga dari kecepatan keseluruhan hingga jawaban selesai.

Sementara agentic AI menambahkan lapisan kompleksitas: agen bisa memanggil tool, mengambil data, atau menjalankan langkah-langkah berurutan. Akibatnya, inference bukan lagi satu panggilan statis, tapi rangkaian eksekusi yang seringkali membutuhkan respons cepat dan konsisten.

AI grids mendukung keduanya lewat beberapa mekanisme praktis:

- Routing inference sesuai latensi: tugas yang sensitif terhadap waktu bisa ditempatkan lebih dekat ke pengguna.

- Autoscaling berbasis beban nyata: saat trafik meningkat, grid menambah kapasitas di lokasi yang tepat.

- Model placement: model yang berbeda (ukuran berbeda, quantization berbeda) bisa dipilih sesuai kebutuhan skenario.

- Queue management: mengatur antrean agar permintaan tidak “meledak” dan kualitas layanan tetap terjaga.

- Fault tolerance: jika satu node bermasalah, workload bisa dialihkan tanpa merusak pengalaman pengguna.

Langkah praktis membangun strategi AI grid untuk optimasi inference

Kalau kamu sedang merancang sistem atau ingin memahami bagaimana implementasi biasanya dilakukan, coba ikuti alur berpikir ini (bukan teori semata):

-

Petakan kebutuhan layanan

Mulai dari SLA: target latensi, throughput, dan ketersediaan. Tentukan juga apakah use case kamu lebih sensitif terhadap “time-to-first-token” atau “total completion time”.

-

Klasifikasikan workload

Bagi permintaan menjadi beberapa kategori, misalnya: chat cepat, analisis dokumen batch, atau agentic workflow yang butuh beberapa langkah.

-

Siapkan strategi penempatan model

Tentukan model mana yang harus selalu tersedia di edge, mana yang bisa di-handle di cloud, dan kapan model versi tertentu ditarik/di-cache.

-

Bangun orkestrasi dan autoscaling

Gunakan sinyal metrik seperti panjang antrean, penggunaan GPU, dan latensi untuk memutuskan scaling. Kuncinya: jangan hanya reaktif, tapi juga prediktif bila memungkinkan.

-

Optimasi runtime inference

Pastikan runtime memanfaatkan akselerator secara efisien. Di titik ini, optimasi seperti batching dinamis dan teknik pengurangan overhead sering sangat berpengaruh.

-

Observabilitas end-to-end

Pasang metrik untuk mengukur bottleneck: dari jaringan, scheduler, sampai eksekusi model. Tanpa observabilitas, grid akan sulit dioptimasi secara berulang.

-

Uji skenario lonjakan trafik

Simulasikan event puncak: apakah antrean menumpuk? apakah latensi meningkat drastis? bagaimana fallback saat node tertentu down?

Metrik yang wajib kamu pantau saat mengoptimasi AI grids

Supaya optimasi inference di jaringan terdistribusi benar-benar terasa, kamu perlu metrik yang tepat. Berikut daftar yang biasanya paling membantu:

- Latency p50/p95/p99: bukan cuma rata-rata, tapi distribusi latensi.

- Time-to-first-token (TTFT): krusial untuk pengalaman chat dan interaksi real-time.

- Throughput (tokens/sec): mengukur performa generatif secara lebih langsung.

- GPU utilization: apakah grid memanfaatkan akselerator secara efisien.

- Queue length dan waiting time: indikator apakah scaling/scheduling efektif.

- Error rate: termasuk timeouts dan kegagalan eksekusi.

- Cost per inference: total biaya dibagi jumlah permintaan atau token.

Studi kasus “pola” yang sering terjadi di operator telekomunikasi

Walau detail implementasi tiap perusahaan berbeda, pola yang sering muncul pada operator telekomunikasi adalah memadukan compute di beberapa lokasi. Misalnya:

- Edge untuk respons cepat: untuk use case yang butuh latensi rendah, seperti layanan pelanggan real-time atau asisten di perangkat tertentu.

- Cloud regional untuk workload berat: untuk tugas yang membutuhkan kapasitas besar atau komputasi lebih lama.

- Failover antar lokasi: jika satu region mengalami kemacetan, workload dialihkan ke lokasi lain.

Dengan pola ini, AI grids tidak hanya meningkatkan performa, tapi juga membuat layanan tetap stabil saat kondisi jaringan dan trafik berubah.

Kesimpulan: grid membuat inference lebih “terukur” dan siap tumbuh

AI grids untuk optimasi inference di jaringan terdistribusi pada dasarnya adalah pendekatan engineering yang lebih matang: bukan sekadar menjalankan model di satu tempat, tapi menyusun sistem agar komputasi AI bisa dipilih, dijadwalkan, dan dikelola

secara dinamis sesuai kebutuhan. Dengan kolaborasi teknologi akselerasi seperti dari NVIDIA dan kapabilitas jaringan dari operator telekomunikasi, generative serta agentic AI bisa diproduksi dengan performa yang lebih andallatensi lebih rendah, efisiensi lebih tinggi, dan biaya yang lebih terkontrol.

Kalau kamu sedang membangun atau mengevaluasi arsitektur AI, fokuslah pada tiga hal: penempatan workload, orkestrasi dinamis, dan observabilitas end-to-end.

Ketiganya biasanya menjadi pembeda antara AI yang “terlihat cepat” di demo, dan AI yang benar-benar siap melayani jutaan permintaan di dunia nyata.

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)