NVIDIA dan Ineffable Bangun Infrastruktur Reinforcement Learning Masa Depan

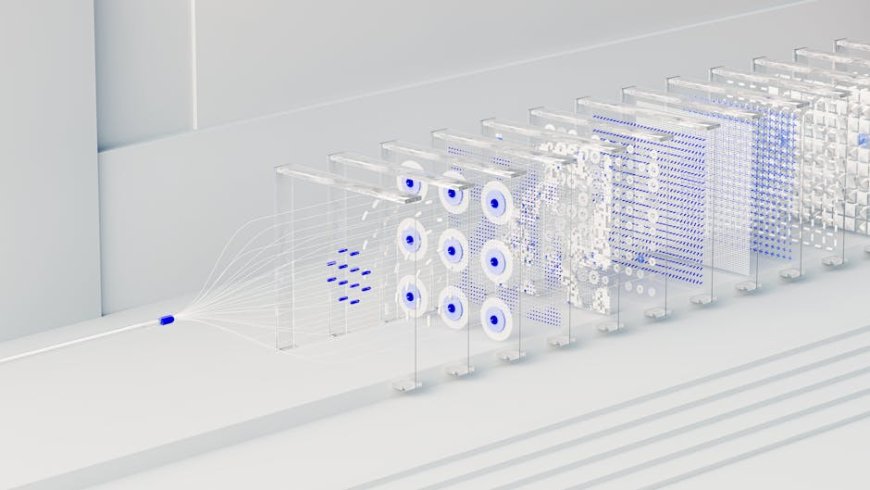

VOXBLICK.COM - Kalau kamu pernah melihat demo robot yang bisa belajar dari percobaankadang cepat, kadang juga “rewel”kamu pasti sadar bahwa reinforcement learning (RL) bukan sekadar soal model yang canggih. Kunci yang sering luput adalah infrastruktur: bagaimana eksperimen dijalankan, data pengalaman dikumpulkan, pelatihan disinkronkan, hingga bagaimana performa bisa diskalakan saat kebutuhan komputasi meningkat. Di sinilah kolaborasi NVIDIA dan Ineffable Intelligence terasa relevan. Mereka membangun infrastruktur reinforcement learning generasi berikutnya agar pelatihan AI lebih efisien, stabil, dan scalable untuk berbagai aplikasimulai dari robotika hingga simulasi strategi.

Yang menarik, fokusnya bukan hanya “membuat training berjalan”, tapi memastikan keseluruhan alur RLdari sampling pengalaman sampai evaluasi kebijakanbisa dioptimalkan.

Dengan arsitektur yang kuat, tim riset bisa mengurangi waktu eksperimen, menekan biaya komputasi, dan meningkatkan peluang hasil yang reprodusibel. Pada praktiknya, ini berarti lebih sedikit trial-and-error yang membuang sumber daya, dan lebih banyak iterasi yang benar-benar mendorong kualitas kebijakan.

Mengapa Reinforcement Learning Sangat Bergantung pada Arsitektur

Reinforcement learning itu unik: model tidak langsung “dilatih dengan label benar-salah”, melainkan belajar dari reward yang muncul setelah tindakan diambil.

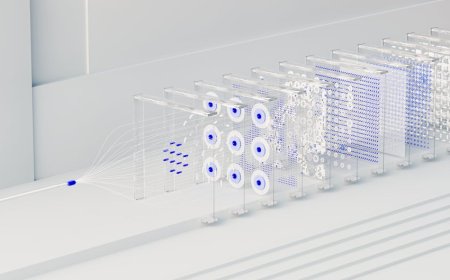

Proses ini menuntut banyak hal sekaliguseksplorasi yang cukup, pembaruan kebijakan yang konsisten, serta pengelolaan pengalaman (experience) yang biasanya berukuran besar. Tanpa infrastruktur yang baik, bottleneck akan muncul di tempat yang berbeda-beda:

- Throughput rendah: GPU menunggu data, atau simulasi lambat sehingga training “kosong”.

- Sinkronisasi bermasalah: saat training terdistribusi, koordinasi antar worker bisa menyebabkan ketidakkonsistenan.

- Replay/buffer tidak efisien: RL sering butuh menyimpan dan mengambil pengalaman kalau desainnya buruk, biaya I/O membengkak.

- Debug sulit: perubahan kecil pada reward, parameter, atau pipeline data bisa menghasilkan perilaku yang sulit dilacak.

NVIDIA dan Ineffable Intelligence menargetkan masalah-masalah “fundamental” ini. Intinya: arsitektur kuat membuat training AI yang menggunakan reinforcement learning bisa lebih efisien dan skalabel, bukan hanya “berjalan di mesin tertentu”.

Infrastruktur generasi berikutnya biasanya bukan satu komponen tunggal, melainkan sistem end-to-end yang menyatukan beberapa lapisan. Kamu bisa membayangkan seperti jalur produksi: kalau satu tahap macet, keseluruhan lini ikut tersendat.

Dalam konteks RL, lapisan yang perlu dipikirkan meliputi:

- Orkestrasi eksperimen: menjalankan banyak run dengan konfigurasi berbeda, tetap terstruktur, dan mudah dibandingkan.

- Manajemen data pengalaman: menyimpan experience, melakukan sampling yang tepat, dan menjaga konsistensi versi.

- Pelatihan terdistribusi: memaksimalkan penggunaan GPU dan mengurangi waktu idle.

- Optimasi simulasi: banyak RL sangat bergantung pada simulator mempercepat simulator berarti mempercepat pembelajaran.

- Evaluasi dan monitoring: mengukur metrik yang relevan (return, success rate, sample efficiency) secara real-time.

Kolaborasi ini relevan karena RL modern sering membutuhkan skala komputasi yang tinggi. Saat kamu menambah jumlah worker, mengalikan episode, atau mencoba variasi reward shaping, infrastruktur harus tetap stabil.

Kalau tidak, performa akan turun atau hasil menjadi tidak konsisten.

Dalam proyek RL, “waktu eksperimen” adalah biaya terbesar kedua setelah komputasi. Tim riset biasanya ingin bereksperimen cepat: mengubah reward, mengganti arsitektur kebijakan, atau menyesuaikan hyperparameter. Namun RL sering sensitif.

Perubahan kecil bisa membuat training:

- Konvergen lebih lambat

- Terjebak pada kebijakan yang buruk

- Menunjukkan fluktuasi reward yang sulit diprediksi

Infrastruktur yang dirancang dengan baik membantu kamu menjaga kualitas eksperimen melalui beberapa mekanisme praktis:

- Pipeline yang terstandardisasi: konfigurasi dan parameter terdokumentasi, sehingga kamu bisa mengulang hasil.

- Monitoring metrik penting: bukan hanya melihat loss, tetapi juga indikator pembelajaran kebijakan.

- Pengelolaan versi: reward function, environment, dan policy checkpoints disimpan dengan jejak yang jelas.

- Pengoptimalan aliran data: memastikan GPU tidak “menunggu” sehingga setiap siklus komputasi memberi manfaat.

Dengan cara ini, pelatihan reinforcement learning menjadi lebih efisienbukan hanya dari sisi kecepatan, tapi juga dari sisi “berapa banyak eksperimen yang benar-benar menghasilkan wawasan”.

Scalable itu terdengar seperti kata pemasaran, tapi di RL itu sangat nyata. Saat eksperimen makin kompleks, kamu butuh menambah kapasitas: lebih banyak GPU, lebih banyak CPU untuk simulasi, dan penyimpanan yang memadai.

Tantangan utamanya adalah menjaga agar sistem tetap konsisten saat skala bertambah.

Beberapa hal yang biasanya jadi titik rawan saat scaling:

- Overhead komunikasi antar worker bisa menghabiskan waktu training.

- Ketidaksinkronan parameter dapat membuat pembelajaran menjadi tidak stabil.

- Struktur buffer/replay harus dirancang agar tidak menjadi bottleneck.

- Variasi environment (misalnya random seed) bisa membuat evaluasi sulit dibandingkan.

Dengan infrastruktur reinforcement learning yang matang, kamu bisa membangun sistem yang mampu menambah worker tanpa mengorbankan stabilitas.

Kolaborasi NVIDIA dan Ineffable Intelligence berupaya memastikan bahwa saat kamu “naik kelas” dari eksperimen kecil ke sistem yang lebih besar, performa dan reliability tetap terjaga.

RL sering dimulai dari riset. Tapi begitu kamu ingin benar-benar menggunakannya di produk (misalnya kontrol robot, sistem rekomendasi adaptif, atau agen yang berinteraksi dengan lingkungan), kamu butuh lebih dari sekadar model yang bagus.

Kamu butuh proses yang bisa diulang, diaudit, dan dipelihara.

Arsitektur infrastruktur yang kuat memberikan dampak langsung ke fase produksi:

- Reprodusibilitas: eksperimen bisa diulang dengan hasil yang lebih konsisten.

- Governance data: data pengalaman dan konfigurasi bisa ditelusuri.

- Integrasi pipeline: training, evaluasi, dan deployment bisa disambungkan lebih rapi.

- Efisiensi biaya: karena training lebih cepat dan tidak banyak “wasted runs”.

Kalau kamu membayangkan tim engineering yang harus mengelola banyak eksperimen RL sekaligus, maka infrastruktur menjadi semacam “sistem operasi” untuk pembelajaran. Tanpa itu, proses menjadi rapuh dan sulit dikembangkan.

Kalau kamu sedang membangun proyek RL (atau sekadar ingin memahami cara kerja yang lebih sehat), berikut beberapa tips yang bisa langsung kamu praktikkan. Anggap ini sebagai checklist sebelum kamu menghabiskan banyak GPU:

- Mulai dari metrik yang jelas: tetapkan apa yang dimaksud “lebih baik” (sample efficiency, reward stability, success rate).

- Standarisasi konfigurasi: simpan hyperparameter, versi environment, dan seed untuk eksperimen.

- Bangun pipeline monitoring sejak awal: jangan menunggu sampai training selesai untuk mengetahui masalah.

- Perhatikan bottleneck: cek apakah GPU idle karena data/simulasi lambat, atau masalah ada di I/O replay buffer.

- Iterasi reward dengan disiplin: reward shaping itu powerful, tapi rawan membuat training terlihat “bagus” sementara sebenarnya mengajarkan perilaku yang salah.

Dengan pendekatan seperti ini, kamu akan merasakan langsung manfaat dari arsitektur reinforcement learning yang kuat: eksperimen lebih terarah, debugging lebih cepat, dan kemampuan scaling lebih realistis.

Ketika NVIDIA dan Ineffable Intelligence membangun infrastruktur reinforcement learning masa depan, dampaknya bukan hanya pada kecepatan training.

Dampak yang lebih besar adalah: lebih banyak eksperimen berkualitas bisa dilakukan dalam waktu yang sama. Itu membuka ruang untuk mencoba algoritma baru, environment baru, dan strategi belajar yang lebih komplekstanpa mengunci tim riset pada infrastruktur yang rapuh.

Ke depan, RL akan semakin sering dipakai untuk sistem yang butuh adaptasi nyata di dunia yang dinamis. Agar agen bisa belajar dengan aman dan efektif, kita memerlukan pipeline yang stabil dari sisi data, simulasi, dan pelatihan.

Dengan fondasi infrastruktur yang kuat, reinforcement learning bisa bergerak lebih cepat dari lab menuju penerapan yang lebih luas.

Kalau kamu ingin ikut merasakan manfaatnya, fokuslah pada satu hal: jangan hanya mengejar model yang paling “wah”.

Pastikan kamu juga membangun jalur training reinforcement learning yang efisien dan scalablekarena di situlah banyak kemenangan kecil akhirnya menghasilkan lompatan besar. Kolaborasi NVIDIA dan Ineffable Intelligence mengingatkan kita bahwa masa depan AI bukan hanya tentang kecerdasan algoritma, tetapi juga tentang kualitas infrastruktur yang menyokongnya.

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)