Decision Tree Kamu Gagal? Pahami Penyebab dan Perbaiki dengan 5 Tips Ini!

VOXBLICK.COM - Pernahkah kamu merasa frustrasi saat model Decision Tree yang sudah kamu bangun dengan susah payah ternyata hasilnya tidak sesuai harapan? Mungkin akurasinya rendah, performanya tidak stabil, atau bahkan memberikan prediksi yang aneh? Tenang saja, kamu tidak sendirian. Banyak praktisi data, baik pemula maupun yang sudah berpengalaman, seringkali menghadapi tantangan serupa saat bekerja dengan Decision Tree.

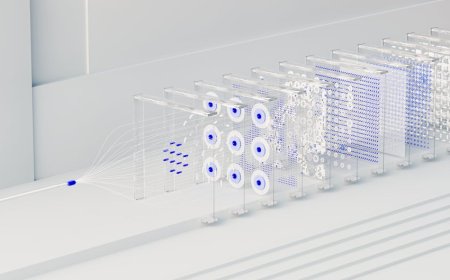

Decision Tree adalah algoritma Machine Learning yang sangat intuitif dan mudah diinterpretasikan. Namun, di balik kesederhanaannya, ada beberapa "jebakan" yang bisa membuat modelmu gagal memberikan hasil yang optimal.

Memahami akar permasalahannya adalah langkah pertama untuk memperbaikinya. Artikel ini akan membimbingmu untuk menyelami tiga alasan utama mengapa Decision Tree-mu mungkin "ngambek" dan, yang lebih penting, memberikan lima tips praktis yang bisa langsung kamu terapkan untuk membuatnya kembali perkasa.

Mengapa Decision Tree-mu Sering Ngambek? Pahami 3 Penyebab Utamanya

Sebelum kita melangkah ke solusi, mari kita bedah dulu mengapa model Decision Tree-mu mungkin tidak bekerja sebaik yang kamu inginkan. Ada tiga biang keladi utama yang sering menjadi penyebab kegagalan:

-

Overfitting (Terlalu Hafal Data Latihan)

Ini adalah masalah paling umum pada Decision Tree. Overfitting terjadi ketika modelmu terlalu kompleks dan "menghafal" data pelatihan hingga ke detail-detail kecil, termasuk noise atau anomali yang sebenarnya tidak mewakili pola umum.

Akibatnya, performa model di data pelatihan mungkin terlihat sangat bagus, tetapi begitu dihadapkan pada data baru yang belum pernah dilihatnya, akurasinya langsung anjlok. Decision Tree sangat rentan terhadap overfitting karena secara default, ia akan terus memecah data hingga setiap daun hanya berisi satu kelas (atau sangat sedikit sampel), kecuali dihentikan.

-

Underfitting (Terlalu Sederhana untuk Memahami Data)

Kebalikan dari overfitting, underfitting terjadi ketika modelmu terlalu sederhana dan tidak mampu menangkap pola atau hubungan yang kompleks dalam data.

Ini bisa terjadi jika Decision Tree-mu terlalu "dangkal" (misalnya, hanya memiliki sedikit cabang atau kedalaman yang sangat terbatas). Model yang underfit tidak akan berkinerja baik baik pada data pelatihan maupun data baru, karena ia gagal mempelajari esensi dari hubungan antar fitur dan target.

-

Sensitivitas Terhadap Data (Rentannya Perubahan Kecil)

Decision Tree, terutama yang tidak diatur dengan baik, bisa sangat sensitif terhadap perubahan kecil pada data. Sedikit perubahan pada satu titik data atau penambahan/pengurangan fitur bisa menghasilkan struktur pohon yang sangat berbeda.

Selain itu, Decision Tree juga rentan terhadap data yang berisik (noisy data) atau data yang tidak seimbang (imbalanced dataset), di mana kelas minoritas mungkin terabaikan, menyebabkan bias dalam prediksi dan mengurangi akurasi model secara keseluruhan.

5 Tips Jitu Agar Decision Tree-mu Kembali Optimal dan Handal

Setelah memahami penyebabnya, kini saatnya kita bertindak! Berikut adalah lima tips praktis yang bisa langsung kamu terapkan untuk memperbaiki dan mengoptimalkan model Decision Tree-mu:

-

1. Pre-processing Data yang Cermat

Dasar dari model yang baik adalah data yang bersih dan relevan. Luangkan waktu untuk melakukan pre-processing data secara menyeluruh. Ini termasuk:

- Menangani Missing Values: Imputasi nilai yang hilang dengan strategi yang tepat (mean, median, mode, atau model yang lebih canggih).

- Mendeteksi dan Menangani Outlier: Outlier bisa sangat mempengaruhi struktur Decision Tree. Identifikasi dan tangani dengan bijak (misalnya, transformasi, capping, atau penghapusan jika relevan).

- Feature Engineering: Ciptakan fitur-fitur baru dari fitur yang sudah ada yang mungkin lebih relevan atau informatif bagi model.

- Normalisasi/Standardisasi (Opsional): Meskipun Decision Tree tidak terlalu sensitif terhadap skala fitur, ini bisa membantu dalam beberapa kasus dan seringkali menjadi praktik baik dalam pipeline Machine Learning secara umum.

Data yang bersih dan terstruktur dengan baik akan memberikan fondasi yang kuat bagi Decision Tree-mu.

-

2. Pengaturan Hyperparameter Tuning yang Tepat

Ini adalah senjata ampuh untuk melawan overfitting dan underfitting. Hyperparameter adalah parameter yang tidak dipelajari dari data, melainkan ditentukan sebelum proses pelatihan.

Untuk Decision Tree, beberapa hyperparameter kunci yang perlu kamu perhatikan adalah:

max_depth: Kedalaman maksimum pohon. Batasi ini untuk mencegah overfitting.min_samples_leaf: Jumlah sampel minimum yang harus ada di setiap daun. Meningkatkan nilai ini akan membuat pohon lebih general dan mengurangi overfitting.min_samples_split: Jumlah sampel minimum yang diperlukan untuk memecah sebuah node. Mirip denganmin_samples_leaf, ini membantu mencegah overfitting.

Gunakan teknik seperti Grid Search atau Random Search dengan Cross-Validation untuk menemukan kombinasi hyperparameter terbaik yang menghasilkan performa optimal.

-

3. Validasi Silang (Cross-Validation) untuk Evaluasi yang Robust

Jangan hanya mengandalkan satu kali split data (train-test split). Gunakan Cross-Validation (misalnya, K-Fold Cross-Validation) untuk mendapatkan estimasi performa model yang lebih robust dan tidak bias.

Dengan Cross-Validation, data dibagi menjadi beberapa "fold", dan model dilatih serta diuji berulang kali pada kombinasi fold yang berbeda. Ini membantu mendeteksi overfitting lebih awal dan memberikan gambaran yang lebih akurat tentang bagaimana modelmu akan berkinerja pada data yang belum pernah dilihat.

-

4. Manfaatkan Ensemble Methods: Kekuatan Bersama Lebih Baik

Jika satu Decision Tree sering gagal, bagaimana jika kita menggabungkan kekuatan banyak Decision Tree? Inilah konsep di balik Ensemble Methods, dan ini sangat efektif! Dua metode paling populer adalah:

- Random Forest (Bagging): Membangun banyak Decision Tree secara independen pada subset data dan fitur yang berbeda. Hasil prediksi kemudian digabungkan (misalnya, melalui voting atau averaging). Ini sangat efektif dalam mengurangi variansi dan overfitting.

- Gradient Boosting (Boosting): Membangun Decision Tree secara sekuensial, di mana setiap pohon baru mencoba memperbaiki kesalahan yang dibuat oleh pohon sebelumnya. Contoh populer termasuk XGBoost, LightGBM, dan CatBoost. Metode ini sangat kuat dalam mengurangi bias dan sering menghasilkan akurasi yang sangat tinggi.

Menggunakan Ensemble Methods seringkali menjadi "solusi ajaib" untuk masalah performa Decision Tree.

-

5. Analisis Fitur (Feature Importance) untuk Pemahaman Mendalam

Decision Tree memiliki kelebihan dalam memberikan informasi tentang fitur mana yang paling penting dalam membuat keputusan. Manfaatkan informasi feature importance yang diberikan oleh modelmu.

Dengan memahami fitur mana yang paling berpengaruh, kamu bisa:

- Melakukan Feature Selection: Menghilangkan fitur-fitur yang kurang relevan dapat mengurangi kompleksitas model, mempercepat pelatihan, dan kadang bahkan meningkatkan performa dengan mengurangi noise.

- Mendapatkan Insight Bisnis: Memahami faktor-faktor pendorong di balik prediksi model bisa memberikan wawasan berharga bagi keputusan bisnis atau penelitian lebih lanjut.

Analisis ini tidak hanya memperbaiki model, tetapi juga meningkatkan interpretasi dan kepercayaan terhadap hasil yang diberikan.

Membangun model Decision Tree yang optimal memang membutuhkan sedikit trial and error, namun dengan pemahaman yang tepat tentang penyebab kegagalan dan penerapan tips-tips di atas, kamu akan selangkah lebih maju dalam menciptakan model Machine

Learning yang lebih handal dan akurat. Jangan takut untuk bereksperimen, sesuaikan strategi dengan karakteristik datamu, dan teruslah belajar dari setiap iterasi. Dengan ketekunan, Decision Tree-mu akan segera kembali ke performa puncaknya!

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)