RTX PC dan DGX Jalankan Open Model AI Lokal di GTC

VOXBLICK.COM - Kamu mungkin sudah sering mendengar tren “AI makin pintar” dan “model makin besar”. Tapi yang sering terlewat adalah pertanyaan praktis: bagaimana kita menjalankan AI open model dengan cepat, stabil, dan biaya yang masuk akaltanpa harus selalu bergantung penuh pada cloud?

Di GTC, NVIDIA menyorot RTX PC dan DGX sebagai dua jalur yang saling melengkapi untuk menjalankan open model AI lokal, termasuk skenario AI agents.

Intinya: kamu bisa memindahkan beban inferensi dan eksperimen dari server jarak jauh ke perangkat lokal, sehingga iterasi lebih cepat, kontrol lebih besar, dan privasi lebih terjaga.

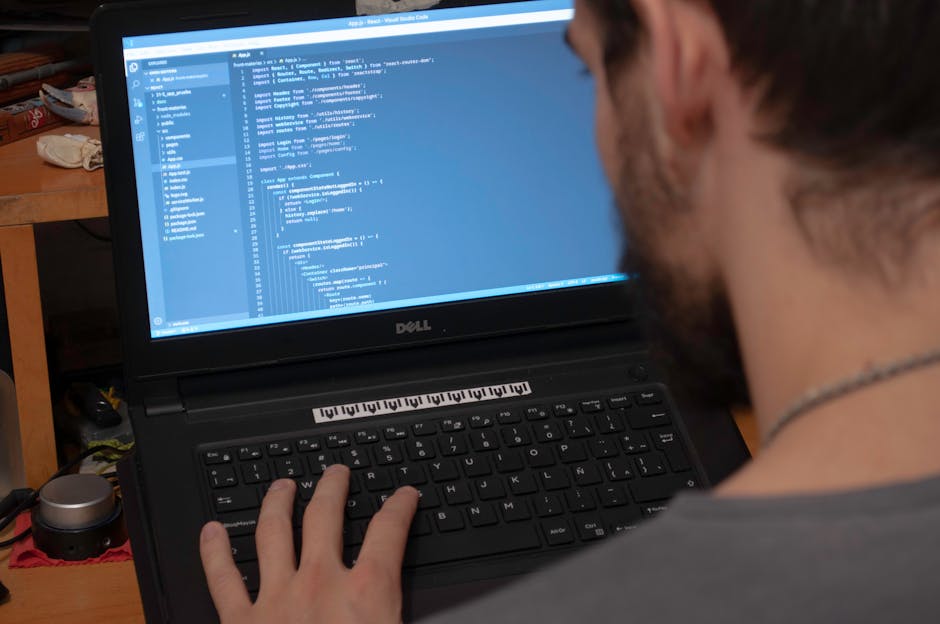

Kalau kamu seorang developer, peneliti, atau tim produk yang ingin membangun fitur AI (chat, summarization, coding assistant, sampai agent yang menjalankan workflow), berita ini penting.

Karena “AI lokal” bukan sekadar soal menjalankan modelmelainkan soal arsitektur sistem, optimasi performa, dan cara mengelola model agar tetap responsif saat digunakan oleh pengguna nyata.

Apa yang Baru di GTC: RTX PC dan DGX untuk Open Model & AI Agents

GTC kali ini menegaskan bahwa NVIDIA mendorong ekosistem yang memungkinkan kamu menjalankan open model secara lokal dengan performa yang kompetitif. Dua platform yang disorot punya peran berbeda:

- RTX PC: cocok untuk eksperimen cepat, prototyping, dan kebutuhan inferensi berskala kecil-menengah. Dengan GPU kelas GeForce/RTX, kamu bisa menjalankan model tanpa harus menunggu provisioning server.

- DGX: ditujukan untuk beban kerja yang lebih berat dan kebutuhan produksi yang ketatmisalnya throughput tinggi, manajemen model yang kompleks, serta penggunaan bersamaan oleh banyak proses/layanan.

Yang menarik adalah fokusnya bukan hanya “bisa jalan”, tapi bagaimana AI agents bisa dijalankan.

AI agents biasanya butuh lebih dari sekadar inferensi: ada orchestration, tool calling, memori/penyimpanan konteks, dan integrasi dengan layanan lain. Dengan eksekusi lokal, kamu bisa mengurangi latensi dan meningkatkan kontrol atas alur agent.

Kenapa AI Lokal Jadi Prioritas: Manfaat Konkret untuk Developer

Media sosial sering menampilkan demo AI yang mulus, tapi di dunia nyata kamu akan berhadapan dengan kendala: latensi, biaya, keamanan data, dan konsistensi performa.

Menjalankan open model AI lokal di RTX PC atau DGX memberi beberapa keuntungan yang bisa langsung kamu rasakan.

- Iterasi lebih cepat: kamu bisa mengubah konfigurasi model, mencoba quantization, mengganti backend inferensi, lalu menguji ulang tanpa menunggu pipeline cloud.

- Kontrol biaya: untuk beban yang sering atau penggunaan internal, biaya cloud per permintaan bisa cepat membengkak. Lokal membuat biaya lebih prediktif.

- Privasi & kepatuhan: data sensitif (misalnya dokumen perusahaan) bisa tetap berada di jaringanmu. Ini penting untuk industri yang punya aturan ketat.

- Latensi lebih rendah: untuk agent yang sering memanggil tool atau melakukan beberapa langkah, pengurangan latensi bisa terasa di pengalaman pengguna.

- Reliabilitas: kamu tidak sepenuhnya bergantung pada ketersediaan layanan eksternal. Kalau internet lambat atau ada gangguan, sistem lokal tetap berjalan.

Kalau kamu sedang membangun produk AI, manfaat ini sering berarti satu hal: time-to-market yang lebih pendek. Kamu tidak hanya “punya AI”, tapi bisa menguji dan menstabilkan AI lebih cepat.

RTX PC vs DGX: Pilih yang Sesuai dengan Kebutuhanmu

Supaya tidak salah langkah, kamu perlu menilai kebutuhan: skala, latensi, dan kompleksitas agent. Berikut cara berpikir yang simpel.

Gunakan RTX PC saat kamu butuh: prototyping dan eksperimen cepat

- Kamu ingin mencoba beberapa open model (misalnya model bahasa untuk chat, coding, atau embedding) dalam waktu singkat.

- Kamu ingin menguji prompt engineering dan tool calling berbasis agent tanpa menunggu deploy ke cloud.

- Team kecil butuh lingkungan yang mudah diatur dan di-replikasi.

Gunakan DGX saat kamu butuh: performa tinggi dan operasi yang lebih “serius”

- Kamu menjalankan banyak request secara bersamaan (misalnya untuk internal enterprise atau layanan yang diakses banyak user).

- Kamu membutuhkan manajemen deployment yang rapi, pipeline model yang lebih kompleks, atau integrasi sistem produksi.

- Kamu ingin stabilitas performa pada berbagai skenario beban (peak hours, batch processing, dan lain-lain).

Intinya: RTX PC itu “kecepatan eksperimen”, sementara DGX itu “kecepatan produksi”. Banyak tim bahkan memulai dari RTX PC untuk validasi, lalu naik kelas ke DGX ketika fitur sudah terbukti dan butuh skala lebih tinggi.

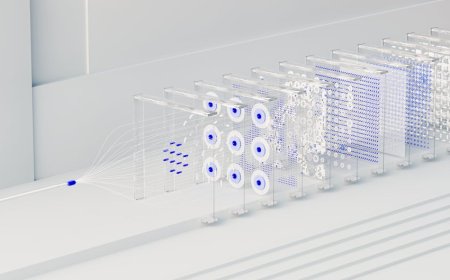

Bagaimana Open Model AI Lokal Bekerja (Secara Praktis)

Ketika orang bilang “menjalankan open model”, biasanya yang dimaksud ada beberapa tahap penting. Agar kamu punya gambaran yang jelas, ini alur yang umum:

- Pilih model: tentukan use case (chat, RAG, coding assistant, summarization, embedding). Pastikan modelnya sesuai ukuran dan kebutuhan kualitas.

- Optimasi inferensi: gunakan teknik seperti quantization atau optimasi runtime agar model lebih cepat tanpa menurunkan kualitas secara berlebihan.

- Siapkan runtime: jalankan model dengan backend inferensi yang mendukung GPU secara efisien.

- Bangun aplikasi: untuk agent, kamu butuh orchestrator, pemanggilan tool, kontrol langkah, dan logging.

- Evaluasi: ukur latensi, throughput, kualitas output, dan stabilitas saat beban meningkat.

Di sinilah RTX PC dan DGX berperan: mereka memberi fondasi performa agar tahap-tahap tersebut tidak terasa berat. Kamu bisa fokus ke kualitas sistem (prompt, workflow agent, retrieval, evaluasi), bukan ke “menunggu server”.

Mulai dari Mana? Rencana Langkah-demi-Langkah untuk Kamu

Kalau kamu ingin mulai membangun AI yang lebih cepat tanpa ketergantungan penuh pada cloud, coba ikuti panduan praktis ini.

- Definisikan satu use case dulu (misalnya: “ringkas dokumen internal” atau “agent yang menjawab tiket support”). Jangan mulai dengan terlalu banyak tujuan.

- Uji 1–2 open model yang sesuai kebutuhan. Fokus pada kualitas yang cukup, bukan yang paling besar.

- Bangun pipeline lokal end-to-end: input → inferensi → (opsional) retrieval → output. Pastikan semuanya berjalan di perangkatmu.

- Tambahkan AI agent secara bertahap: mulai dari agent yang sederhana (misalnya tool calling untuk pencarian dokumen), lalu naikkan kemampuan bertahap.

- Optimasi performa: coba konfigurasi runtime, batching (jika relevan), dan quantization yang sesuai.

- Uji skenario nyata: lakukan pengujian dengan data yang mirip produksi, termasuk variasi panjang input dan pola permintaan.

- Siapkan monitoring: catat latensi, error rate, dan kualitas. Agent yang bagus bukan cuma “bisa jalan”, tapi juga konsisten.

Dengan pendekatan ini, kamu tidak hanya “mengikuti hype GTC”, tapi benar-benar membangun sistem yang siap dipakai.

Tips Praktis Mengoptimalkan AI Lokal di RTX PC atau DGX

- Mulai dari ukuran model yang masuk akal: model terlalu besar bisa membuat iterasi lambat. Pilih yang paling “balance” untuk use case kamu.

- Prioritaskan latensi untuk agent: agent sering melakukan beberapa langkah. Optimasi di level runtime dan tool workflow biasanya memberi dampak terbesar.

- Gunakan RAG bila output harus berbasis dokumen: open model tanpa konteks dokumen sering menghasilkan jawaban generik. RAG membuat agent lebih relevan.

- Pastikan keamanan data: walaupun lokal, tetap butuh kontrol akses, enkripsi, dan manajemen izin untuk data sensitif.

- Evaluasi dengan metrik yang jelas: misalnya relevansi untuk RAG, correctness untuk tool calling, dan kepuasan pengguna untuk chat.

Kenapa Ini Penting untuk Masa Depan AI: Dari Demo ke Produk

Yang membuat sorotan RTX PC dan DGX di GTC terasa “lebih dari sekadar presentasi” adalah arah besarnya: NVIDIA mendorong eksekusi open model AI lokal agar lebih praktis untuk developer.

Saat AI agents bisa dijalankan secara lokal, kamu bisa membangun produk yang lebih responsif, lebih aman, dan lebih mudah dikontrol.

Kalau kamu sedang merancang sistem AI, anggap ini sebagai kesempatan untuk mempercepat siklus pengembangan: mulai dari prototyping di RTX PC, lalu tingkatkan ke DGX ketika butuh performa dan skala.

Dengan demikian, cloud tetap bisa jadi opsibukan keharusan.

GTC menegaskan bahwa masa depan AI bukan hanya soal model yang besar, tapi juga soal ekosistem yang membuat model itu mudah dijalankan di tempat kamu.

Dan ketika kamu bisa menjalankan open model serta AI agents lokal dengan cepat, kamu akan lebih cepat belajar, lebih cepat memperbaiki, dan lebih cepat menghadirkan nilai untuk pengguna.

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)