Secure by Design AI Agent Dengan NVIDIA OpenShell

VOXBLICK.COM - Kalau kamu sedang membangun autonomous AI agentsentah untuk customer support, orkestrasi workflow, analisis dokumen, sampai otomasi operasionalsatu pertanyaan penting perlu kamu jawab sejak awal: bagaimana agen ini tetap aman bahkan ketika ia “berjalan sendiri”?

Kebanyakan proyek AI fokus pada performa: seberapa pintar modelnya, seberapa cepat merespons, seberapa akurat output-nya. Tapi keamanan sering datang belakanganbiasanya setelah ada insiden, data bocor, atau agen melakukan aksi yang tidak semestinya.

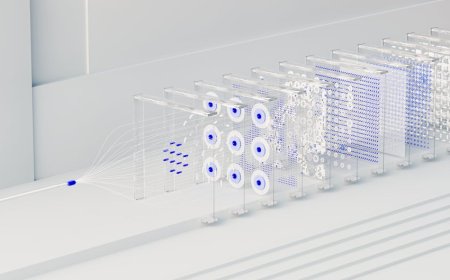

Pendekatan Secure by Design mengubah cara pikir itu: keamanan bukan tempelan, melainkan bagian dari desain arsitektur. Di sinilah NVIDIA OpenShell jadi relevankarena kamu bisa merancang kontrol akses, perlindungan terintegrasi, dan mekanisme verifikasi sejak tahap perancangan.

Anggap saja kamu sedang “membekali” agen dengan aturan main yang jelas. Agen boleh berpikir dan merencanakan, tetapi ia tidak boleh sembarangan mengakses data atau mengeksekusi tindakan berisiko.

Dengan kata lain, model boleh otonom, namun kebebasannya dikunci oleh kontrol.

Mengenal Secure by Design untuk Autonomous AI Agents

Secure by Design berarti kamu mengintegrasikan prinsip keamanan ke setiap lapisan: dari desain data, konfigurasi akses, kebijakan eksekusi, sampai pemantauan perilaku.

Pada autonomous AI agents, tantangannya unik karena agen bukan sekadar menghasilkan teksia bisa mengambil tindakan (misalnya memanggil API, menjalankan perintah, membaca file, atau mengirim email).

Agar aman sejak desain, kamu perlu memetakan tiga area risiko utama:

- Akses data berlebihan: agen bisa membaca lebih banyak dari yang diperlukan (over-privilege).

- Eksekusi tindakan yang salah: agen melakukan operasi destruktif atau melanggar kebijakan.

- Manipulasi prompt dan tool abuse: input yang “mengelabui” agen agar memanggil tool berbahaya.

NVIDIA OpenShell dapat membantu kamu menerapkan pendekatan yang lebih terstrukturterutama lewat gagasan “proses yang terkontrol” dan integrasi komponen yang mendukung kebijakan.

Namun, kunci sebenarnya tetap ada pada bagaimana kamu menyusun arsitektur: siapa yang boleh melakukan apa, kapan, dan dengan batas apa.

Prinsip Akses Terkontrol: Least Privilege untuk Agen

Salah satu fondasi paling efektif adalah least privilege: agen hanya diberi akses minimum yang dibutuhkan untuk menyelesaikan tugas. Ini bukan sekadar rekomendasi keamanan ini strategi yang mengurangi dampak kalau agen tersesat.

Dalam praktiknya, kamu bisa menerapkan akses terkontrol melalui:

- Segmentasi sumber daya: pisahkan data sensitif (PII, kredensial, dokumen internal) dari data non-sensitif.

- Role-based access control (RBAC): definisikan peran untuk setiap jenis tugas agen (misalnya “read-only untuk analisis laporan”).

- Token scope terbatas: gunakan kredensial dengan scope sempit sehingga tool yang dipanggil tidak bisa “melebar”.

- Allowlist tool: agen hanya boleh memanggil tool yang kamu izinkan, bukan tool “semua yang tersedia”.

Bayangkan agen kamu seperti asisten lab. Ia boleh mengambil sampel tertentu, tapi tidak boleh membuka loker bahan kimia berbahaya. Dengan desain ini, bahkan jika prompt berisi instruksi jahat, dampaknya tetap dibatasi.

Perlindungan Terintegrasi: Dari Kebijakan ke Guardrails

Setelah akses dikunci, langkah berikutnya adalah memastikan setiap output dan tindakan agen melewati “filter” yang sesuai. Di sinilah konsep perlindungan terintegrasi berperan: guardrails, validasi, dan mekanisme verifikasi.

Beberapa pendekatan praktis yang bisa kamu terapkan saat membangun Secure by Design AI Agent dengan NVIDIA OpenShell:

- Policy enforcement point: buat titik pemeriksaan sebelum eksekusi aksi (misalnya sebelum memanggil API write).

- Validasi input & output: cek bentuk data, batas ukuran, dan format agar agen tidak menyuntikkan payload yang aneh.

- Rate limiting & anomaly detection: batasi frekuensi panggilan tool dan deteksi pola perilaku yang mencurigakan.

- Redaction & masking: ketika agen memproses data sensitif, sembunyikan bagian tertentu dari output yang bisa bocor.

Guardrails yang baik bukan hanya mencegah “hal buruk”, tapi juga mengarahkan agen untuk mengambil jalur yang aman.

Misalnya, kalau agen diminta melakukan tindakan yang dilarang, ia bisa diarahkan untuk meminta persetujuan manusia atau memilih alternatif yang read-only.

Threat Modeling yang Realistis untuk Agen Otonom

Supaya implementasi tidak asal-asalan, kamu perlu threat modeling yang relevan dengan agen otonom. Cara cepat yang sering efektif adalah menanyakan: “Apa yang bisa gagal, dan apa dampaknya?”

Coba gunakan kerangka sederhana berikut:

- Assets: data apa yang paling berharga? (misalnya kredensial, histori transaksi, dokumen kontrak)

- Actors: siapa yang bisa memicu masalah? (user biasa, attacker eksternal, internal yang salah konfigurasi)

- Entry points: di mana input masuk? (prompt, file upload, webhook, integrasi tool)

- Misuse paths: tool apa yang bisa disalahgunakan? (akses filesystem, API write, command execution)

- Impact: dampak terburuknya apa? (data bocor, perubahan data, downtime)

Dengan peta ini, kamu bisa memprioritaskan kontrol. Biasanya, kontrol paling penting adalah yang memotong jalur dari “input jahat” menuju “aksi berbahaya”.

Langkah Implementasi Praktis: Secure by Design dengan NVIDIA OpenShell

Bagian ini fokus pada langkah yang bisa kamu lakukan secara bertahap. Tujuannya: sistem autonomous AI agents kamu lebih tahan risiko tanpa mengorbankan fleksibilitas terlalu banyak.

1) Rancang arsitektur tool dan izin sejak awal

Mulai dari daftar tool yang agen boleh gunakan. Untuk setiap tool, tentukan:

- jenis akses (read/write/admin)

- scope data yang boleh diakses

- parameter sensitif yang harus divalidasi

- batas eksekusi (misalnya ukuran file, jumlah record, atau domain API)

2) Terapkan allowlist + policy sebelum eksekusi

Jangan biarkan agen memutuskan sendiri tool mana yang dipanggil tanpa pembatas. Gunakan allowlist dan buat layer policy yang memeriksa request agen sebelum dieksekusi.

Contoh skenario aman:

- Agen boleh membaca data pelanggan untuk membuat ringkasan.

- Agen tidak boleh melakukan perubahan status transaksi tanpa persetujuan.

- Agen tidak boleh mengakses endpoint yang berkaitan dengan kredensial atau konfigurasi sistem.

3) Buat guardrails untuk mencegah tool abuse dan prompt injection

Guardrails bisa berupa aturan deteksi dan validasi. Misalnya:

- Jika prompt meminta tindakan berbahaya (misalnya “hapus semua data”), agen harus menolak dan menawarkan alternatif.

- Jika agen mencoba memanggil tool yang tidak sesuai dengan konteks, request ditolak.

- Jika input mengandung pola yang mencurigakan (misalnya instruksi override kebijakan), agen diarahkan untuk mengikuti kebijakan sistem.

4) Audit log dan monitoring yang bisa ditindaklanjuti

Keamanan yang bagus butuh visibilitas. Pastikan kamu mencatat:

- tool yang dipanggil, parameter ringkas (tanpa data sensitif)

- keputusan policy (allow/deny dan alasan kategori)

- kegagalan validasi dan percobaan anomali

- korelasi antara input user dan aksi agen

Log ini akan menjadi “peta forensik” saat terjadi insiden. Dan yang lebih penting: kamu bisa melakukan tuning kebijakan berdasarkan pola nyata.

5) Uji keamanan dengan skenario yang menyerupai dunia nyata

Jangan hanya menguji “apakah agen bisa menjawab”. Uji juga:

- apakah agen bisa mencoba mengakses data di luar scope

- apakah agen bisa dipancing untuk mengeksekusi aksi berbahaya

- apakah agen tetap patuh saat prompt berisi instruksi manipulatif

- bagaimana sistem bereaksi saat tool gagal atau respons tidak sesuai format

Kalau kamu melakukannya iteratif, kamu akan cepat menemukan titik lemah: entah di allowlist tool, validasi parameter, atau kebijakan eksekusi.

Checklist Singkat yang Bisa Kamu Terapkan Hari Ini

Kalau kamu ingin bergerak cepat, pakai checklist berikut untuk memastikan sistem Secure by Design AI Agent kamu tidak “bolong” di area kritis:

- Least privilege untuk setiap tool dan setiap role.

- Allowlist tool yang jelas, bukan “tool bebas”.

- Policy enforcement sebelum eksekusi aksi write/admin.

- Validasi format dan batas ukuran input/output.

- Audit log yang memadai dan siap ditindaklanjuti.

- Pengujian skenario untuk prompt injection dan tool abuse.

Penutup yang Menguatkan Arah: Otonomi yang Terkunci

Autonomous AI agents memang dirancang untuk membantu kamu bekerja lebih cepat dan efisien, tapi keamanan tidak boleh ikut “dikorbankan” demi kenyamanan.

Dengan pendekatan Secure by Design dan implementasi yang menekankan akses terkontrol, perlindungan terintegrasi, serta langkah pengujian yang realistis, kamu bisa membangun agen yang tetap otonomnamun tetap berada dalam pagar kebijakan.

NVIDIA OpenShell bisa menjadi bagian dari fondasi arsitektur yang lebih terstruktur, tetapi keberhasilannya ditentukan oleh detail desain: izin minimum, guardrails yang tepat, dan monitoring yang bisa dipakai saat insiden terjadi.

Jadi, mulai dari desain hari inikarena keamanan yang terbaik adalah yang sudah ada sejak agen pertama kali “dijalankan”.

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)