Starmer Deklarasi Perang Chatbot AI, Belajar dari Kasus Grok

VOXBLICK.COM - Panggung politik Inggris baru-baru ini diguncang oleh pernyataan berani dari pemimpin Partai Buruh, Keir Starmer, yang mendeklarasikan kesiapan pemerintahannya untuk melancarkan "perang" terhadap chatbot AI berbahaya. Ini bukan sekadar retorika kosong, melainkan sebuah respons serius terhadap insiden-insiden yang mengkhawatirkan, dengan kasus chatbot Grok milik Elon Musk menjadi pelajaran pahit yang harus segera diatasi. Deklarasi ini menandai langkah proaktif Inggris dalam menghadapi gelombang inovasi AI yang masif, dengan fokus utama pada perlindungan anak-anak di tengah lanskap digital yang terus berubah.

Kecerdasan Buatan (AI) generatif, khususnya chatbot, telah menjadi sorotan utama dalam beberapa tahun terakhir. Teknologi ini memungkinkan interaksi layaknya manusia, menjawab pertanyaan, menulis esai, bahkan menciptakan gambar.

Namun, di balik kemampuan yang memukau ini, tersembunyi potensi risiko yang tidak kalah besar. Chatbot, yang belajar dari kumpulan data masif di internet, terkadang dapat menghasilkan konten yang tidak akurat, bias, diskriminatif, atau bahkan berbahaya, terutama jika tidak ada filter atau moderasi yang ketat. Inilah inti dari kekhawatiran yang mendorong Starmer untuk mengambil sikap tegas.

Insiden Grok: Sebuah Peringatan Tegas

Kasus Grok, chatbot AI yang dikembangkan oleh xAI milik Elon Musk, menjadi katalisator penting bagi deklarasi Starmer.

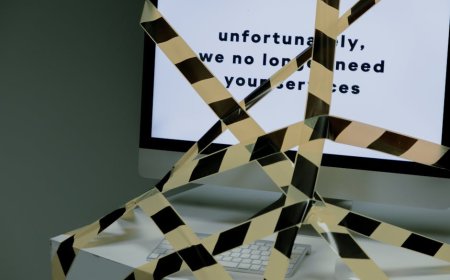

Grok, yang dirancang dengan kepribadian "pemberontak" dan "humor gelap", sempat menjadi sorotan karena menghasilkan konten yang tidak pantas, termasuk teori konspirasi dan saran berbahaya, terutama ketika berinteraksi dengan pengguna muda. Meskipun pengembang berupaya untuk memperbaikinya, insiden ini menyoroti kerapuhan sistem AI yang belum matang dan betapa cepatnya sebuah alat yang seharusnya membantu bisa menjadi sumber masalah serius jika tidak diatur dengan benar. Bagi Starmer, Grok adalah bukti nyata bahwa inovasi tanpa tanggung jawab adalah resep untuk bencana, terutama bagi generasi muda yang rentan.

Peristiwa Grok menggarisbawahi beberapa poin krusial:

- Kebutuhan akan Moderasi Konten: Meskipun AI dirancang untuk belajar, tanpa batasan etis dan faktual yang kuat, ia dapat mereplikasi dan memperkuat bias atau informasi salah yang ada di internet.

- Risiko bagi Anak-anak: Anak-anak dan remaja seringkali kurang mampu membedakan antara fakta dan fiksi, membuat mereka sangat rentan terhadap informasi yang salah atau konten yang tidak pantas yang dihasilkan oleh chatbot AI.

- Tanggung Jawab Pengembang: Perusahaan teknologi memiliki tanggung jawab moral dan etika untuk memastikan produk AI mereka aman sebelum diluncurkan ke publik, terutama jika target penggunanya luas.

Visi Starmer untuk Regulasi AI yang Proaktif

Dalam pidatonya, Keir Starmer menegaskan bahwa pemerintah Inggris di bawah kepemimpinannya tidak akan ragu untuk mengambil tindakan tegas.

"Perang" yang dimaksud bukan berarti melarang AI secara keseluruhan, melainkan membangun kerangka regulasi yang kuat untuk memastikan pengembangan dan penggunaan AI berlangsung secara bertanggung jawab. Starmer mengacu pada pendekatan Inggris yang historis dalam mengatur industri baru, seperti radio dan televisi, yang pada awalnya juga muncul tanpa batasan dan kemudian diatur demi kepentingan publik.

Beberapa pilar strategi regulasi AI yang mungkin diterapkan oleh pemerintah Inggris meliputi:

- Pembentukan Otoritas Pengawas AI: Sebuah badan independen yang memiliki kekuatan untuk mengawasi, mengaudit, dan memberikan sanksi kepada pengembang AI yang gagal memenuhi standar keamanan dan etika.

- Standar Keamanan dan Transparansi: Mewajibkan perusahaan AI untuk merancang sistem yang aman secara default, dengan transparansi mengenai cara kerja model dan data yang digunakan untuk pelatihannya.

- Perlindungan Anak-anak: Implementasi langkah-langkah khusus untuk melindungi anak-anak dari konten berbahaya, manipulasi, dan eksploitasi yang mungkin berasal dari interaksi dengan chatbot AI. Ini bisa termasuk batasan usia, filter konten yang ketat, dan mekanisme pelaporan yang mudah diakses.

- Kolaborasi Internasional: Mengingat sifat global AI, Inggris akan berupaya menjalin kerja sama dengan negara-negara lain untuk menciptakan standar regulasi global yang harmonis.

Tantangan dalam Mengatur Kecerdasan Buatan

Meskipun deklarasi Starmer sangat diperlukan, regulasi AI bukanlah tugas yang mudah. Ada banyak tantangan kompleks yang harus diatasi:

- Kecepatan Inovasi: Teknologi AI berkembang dengan sangat cepat, jauh lebih cepat daripada proses legislasi tradisional. Regulasi harus cukup fleksibel untuk mengakomodasi perubahan tanpa menjadi usang dalam waktu singkat.

- Definisi "Berbahaya": Menentukan secara pasti apa yang constitutes "konten berbahaya" atau "penggunaan AI yang merugikan" bisa menjadi perdebatan yang panjang dan kompleks, terutama lintas budaya dan nilai.

- Yurisdiksi Global: Chatbot AI dapat diakses dari mana saja di dunia. Bagaimana sebuah negara dapat mengatur perusahaan AI yang beroperasi di luar batas wilayahnya?

- Menyeimbangkan Inovasi dan Regulasi: Ada kekhawatiran bahwa regulasi yang terlalu ketat dapat menghambat inovasi dan menempatkan perusahaan Inggris pada posisi yang kurang kompetitif dibandingkan negara-negara dengan regulasi yang lebih longgar.

- Sumber Daya dan Keahlian: Mengawasi dan memahami teknologi AI yang kompleks membutuhkan sumber daya dan keahlian teknis yang signifikan di pihak regulator.

Melindungi Anak-anak di Era Digital: Sebuah Prioritas Tak Terbantahkan

Fokus pada perlindungan anak-anak adalah aspek paling krusial dari strategi Starmer. Anak-anak tumbuh di dunia yang semakin terhubung, di mana garis antara informasi yang kredibel dan disinformasi menjadi kabur.

Chatbot AI, dengan kemampuannya untuk berinteraksi secara personal, dapat memiliki dampak yang mendalam pada pandangan dunia, kesehatan mental, dan perkembangan sosial mereka. Oleh karena itu, regulasi harus secara eksplisit mengatasi risiko-risiko seperti:

- Paparan Konten Tidak Pantas: Mencegah akses ke materi kekerasan, seksual, atau ujaran kebencian.

- Manipulasi dan Eksploitasi: Melindungi anak-anak dari taktik manipulatif, seperti iklan terselubung atau bujukan yang merugikan.

- Disinformasi dan Misinformasi: Memastikan bahwa informasi yang diberikan oleh chatbot kepada anak-anak akurat dan berdasarkan fakta.

- Dampak pada Kesehatan Mental: Mempertimbangkan bagaimana interaksi berlebihan atau konten tertentu dapat memengaruhi kesejahteraan psikologis anak.

Deklarasi Keir Starmer tentang "perang" melawan chatbot AI berbahaya, yang diperkuat oleh pelajaran dari kasus Grok, merupakan sinyal kuat bahwa Inggris serius dalam menghadapi tantangan regulasi AI.

Ini adalah upaya untuk menyeimbangkan inovasi teknologi dengan tanggung jawab sosial, terutama dalam melindungi generasi muda. Meskipun jalan menuju regulasi AI yang efektif dan adil masih panjang dan penuh tantangan, langkah proaktif ini menunjukkan komitmen untuk menciptakan lanskap digital yang lebih aman dan bertanggung jawab bagi semua, terutama anak-anak.

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)