TurboQuant KV Cache Compression untuk Inference Lebih Efisien

VOXBLICK.COM - Kamu mungkin pernah merasakan fenomena yang terasa “aneh”: model bahasa besar terlihat mampu menghasilkan jawaban yang panjang dan berkualitas, tapi saat konteks makin panjang, performanya justru melambat. Penyebabnya sering bukan pada kualitas model, melainkan pada bottleneck memorikhususnya KV cache (Key-Value cache) yang membengkak seiring bertambahnya token. Di sinilah TurboQuant KV cache compression berperan: ia dirancang untuk menekan kebutuhan memori tanpa mengorbankan kualitas inference secara berlebihan, sehingga throughput meningkat dan kamu bisa memanfaatkan context window lebih efisien.

Pada artikel ini, kita akan membedah TurboQuant dengan cara yang praktis: mulai dari konsep KV cache, kenapa kompresi itu penting, bagaimana TurboQuant bekerja (secara konseptual), hingga dampaknya pada throughput dan kemampuan menangani konteks

lebih panjang. Anggap saja ini sebagai panduan yang bisa kamu pakai untuk memahami dan mengevaluasi teknik kompresi KV cache di sistem inference kamu.

Kenapa KV Cache Jadi Bottleneck saat Inference Makin Panjang?

Untuk menghasilkan token berikutnya, transformer perlu “mengingat” informasi dari token-token sebelumnya. Dalam arsitektur transformer modern, mekanisme attention menghitung hubungan antara token baru dan token lama.

Agar tidak menghitung ulang semuanya dari nol setiap langkah, sistem inference menyimpan hasil antara berupa KV cache.

KV cache berisi dua komponen utama:

- Key (K): representasi untuk mencocokkan relevansi token-token sebelumnya.

- Value (V): informasi yang akan digabungkan sesuai bobot attention.

Masalahnya, ukuran KV cache tumbuh hampir linear terhadap panjang konteks. Artinya, ketika kamu meningkatkan context window (misalnya dari 4k ke 16k token), kebutuhan memori untuk menyimpan KV cache bisa melonjak.

Pada praktiknya, hal ini sering menyebabkan:

- Latency naik karena sistem menunggu akses memori atau mengalami bottleneck bandwidth.

- Throughput turun karena GPU tidak bisa menampung sebanyak mungkin batch/permintaan.

- Biaya inferensi meningkat karena perlu hardware lebih besar atau optimasi tambahan.

Jadi, kompresi KV cache menjadi strategi yang sangat masuk akal: kalau cache bisa disimpan dengan lebih hemat memori, sistem bisa menjalankan lebih banyak request sekaligus atau mempertahankan kecepatan saat konteks panjang.

Konsep TurboQuant: Kompresi KV Cache tanpa Mengorbankan Terlalu Banyak Kualitas

TurboQuant KV cache compression pada dasarnya adalah pendekatan kuantisasi (quantization) untuk mengurangi ukuran KV cache yang disimpan selama inference.

Ide besarnya: daripada menyimpan KV dalam presisi tinggi (misalnya FP16 atau BF16), kamu menyimpannya dalam format yang lebih “ringkas” (misalnya dengan bit-width lebih kecil atau skema kuantisasi tertentu).

Secara konseptual, prosesnya biasanya melibatkan:

- Representasi ulang nilai K dan V ke bentuk yang lebih hemat (kompresi/kuantisasi).

- Rekonstruksi saat dibutuhkan untuk menghitung attention pada langkah berikutnya.

- Pengendalian trade-off antara penghematan memori dan potensi penurunan akurasi.

Yang membuat TurboQuant menarik adalah fokusnya pada efisiensi inference untuk model besar.

Dalam skenario nyata, bahkan penurunan kualitas kecil bisa berdampak pada kualitas output namun jika teknik kompresinya dirancang dengan cerdas, kualitas dapat tetap “cukup dekat” dengan baseline sementara memori dan throughput membaik.

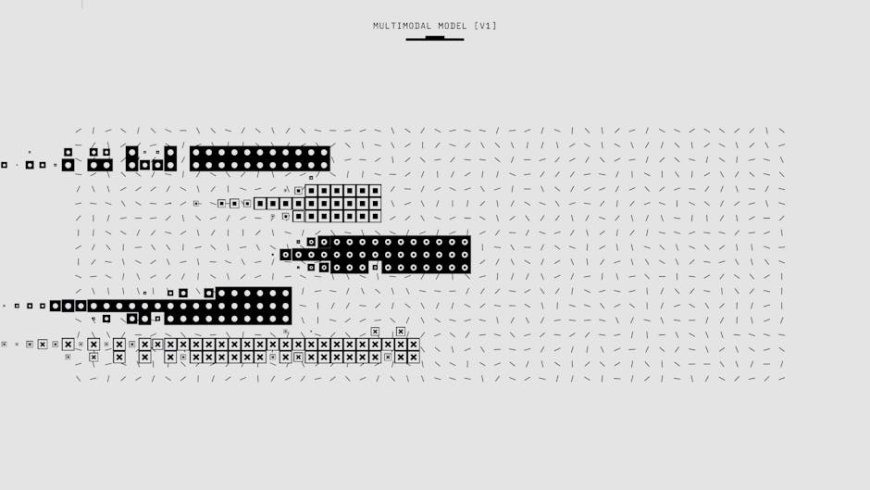

Bagaimana TurboQuant Bekerja Secara Alur (Versi Praktis)

Karena detail implementasi bisa berbeda tergantung framework/stack yang digunakan, kita bahas alur kerja TurboQuant secara umumyang relevan untuk kamu saat melakukan evaluasi atau integrasi.

-

1) Saat token baru diproses

Model menghitung K dan V dari token-token yang masuk. -

2) KV cache disimpan dengan skema kuantisasi

Nilai K dan V tidak lagi disimpan dalam format presisi penuh, melainkan dalam bentuk terkompresi/terkuantisasi. -

3) Ketika attention dihitung pada langkah berikutnya

Sistem membaca KV cache terkompresi, lalu melakukan dekuantisasi (atau menggunakan representasi terkuantisasi langsung sesuai strategi) agar perhitungan attention tetap berjalan. -

4) Lanjut sampai context window selesai

Karena cache lebih kecil, GPU dapat menampung lebih banyak token/cakupan konteks sebelum kehabisan memori.

Hasil akhirnya adalah memori lebih hemat. Dampaknya biasanya terasa sebagai:

- throughput meningkat (lebih banyak token diproses per detik atau lebih banyak request per batch),

- latency membaik saat konteks panjang,

- context window bisa diperluas tanpa harus menaikkan kebutuhan VRAM secara proporsional.

Dampak pada Throughput: Kenapa Kompresi Bisa Membuat Model “Lebih Cepat”?

Secara intuitif, kompresi bisa terdengar seperti “tambah kerja”. Namun pada sistem inference modern, bottleneck sering kali bukan pada komputasi murni, melainkan pada akses memori dan kapasitas penempatan cache di GPU.

Dengan TurboQuant, ukuran KV cache berkurang. Konsekuensinya:

- Lebih banyak KV cache muat di VRAM

GPU bisa menyimpan lebih banyak state untuk batch yang sama, atau melayani lebih banyak request secara paralel. - Bandwidth memori efektif meningkat

Data yang dipindahkan (atau dibaca) lebih kecil, sehingga waktu akses menurun. - Batching lebih optimal

Sistem scheduler bisa menggabungkan request dengan lebih agresif karena kapasitas memori tidak cepat habis.

Dalam praktiknya, kamu akan melihat throughput yang lebih stabil ketika panjang prompt meningkat. Bahkan jika ada overhead dekuantisasi, keuntungan dari pengurangan data yang ditransfer sering kali lebih besar.

Dampak pada Context Window: Inference Lebih Efisien untuk Prompt Panjang

Context window menentukan seberapa panjang input (dan sejarah percakapan) yang bisa dipertimbangkan model. Tanpa kompresi KV cache, memperpanjang context window sering kali membuat sistem cepat mentok karena memori habis.

Dengan TurboQuant KV cache compression, cache yang lebih kecil memungkinkan:

- meningkatkan panjang konteks tanpa upgrade hardware yang drastis,

- mengurangi risiko OOM (out-of-memory) saat prompt panjang atau saat banyak request paralel,

- menjaga kualitas selama kompresi masih berada dalam toleransi yang sesuai untuk model dan task.

Kalau kamu mengelola aplikasi seperti chatbot enterprise, ringkasan dokumen panjang, atau analisis log yang butuh konteks besar, kemampuan untuk memperluas context window secara efisien adalah nilai bisnis yang nyata: jawaban lebih relevan, lebih

konsisten, dan biaya komputasi cenderung lebih terkendali.

Trade-off yang Perlu Kamu Perhatikan (Kualitas vs Efisiensi)

Walau kompresi KV cache menjanjikan efisiensi, kamu tetap perlu mengukur dampaknya terhadap kualitas output. Trade-off yang umum terjadi pada kuantisasi adalah:

- Perubahan numerik yang bisa memengaruhi perhitungan attention.

- Potensi penurunan akurasi pada tugas yang sensitif terhadap ketelitian (misalnya reasoning yang panjang).

- Variabilitas performa antar model, ukuran, dan domain data.

Karena itu, pendekatan yang paling aman adalah melakukan evaluasi terukur. Kamu bisa menyiapkan metrik seperti:

- Throughput/token per detik pada beberapa panjang prompt (mis. 2k, 8k, 16k).

- Latency end-to-end untuk skenario batch dan paralel request.

- Quality check menggunakan benchmark internal atau set pertanyaan representatif.

Dengan begitu, kamu tidak hanya “percaya” pada kompresi, tapi benar-benar melihat apakah TurboQuant cocok untuk workload kamu.

Tips Implementasi dan Evaluasi untuk Kamu yang Ingin Praktis

Agar TurboQuant KV cache compression bisa memberi manfaat maksimal di produksi, coba langkah praktis ini:

- Mulai dari baseline

Jalankan inference tanpa kompresi (atau mode default) untuk mengukur throughput, latency, dan kualitas. - Uji pada beberapa panjang konteks

Kompresi biasanya paling terasa pada prompt panjang. Bandingkan metrik di beberapa ukuran context window. - Perhatikan beban paralel

Uji dengan jumlah request bersamaan yang mendekati kondisi nyata. Bottleneck memori sering muncul di sini. - Lakukan quality regression test

Jangan hanya lihat kecepatan. Pastikan jawaban tetap memenuhi standar kualitas untuk task utama kamu. - Optimalkan konfigurasi kompresi

Jika framework menyediakan parameter (misalnya bit-width atau strategi kuantisasi), lakukan sweep kecil untuk menemukan titik terbaik.

Dengan pendekatan ini, kamu akan mendapatkan insight yang lebih akurat: apakah TurboQuant benar-benar meningkatkan efisiensi untuk model dan skenario kamu.

Kenapa TurboQuant Relevan untuk Masa Depan Inference Model Besar?

Model besar semakin sering dipakai untuk kebutuhan yang membutuhkan konteks panjang: analisis dokumen, pencarian berbasis percakapan, agent yang mempertahankan state, sampai aplikasi multi-modal yang memproses banyak token per permintaan.

Tantangan memori tidak akan hilangbahkan bisa makin berat seiring meningkatnya ukuran model dan panjang konteks.

TurboQuant KV cache compression menawarkan jalan yang realistis: mengurangi penggunaan memori tanpa harus selalu mengandalkan scaling hardware. Jika kamu mengelola sistem inference, strategi seperti ini membantu kamu:

- mendukung context window lebih panjang,

- meningkatkan throughput dan menjaga latency,

- mengoptimalkan biaya operasional ketika beban trafik meningkat.

Intinya, kompresi KV cache bukan sekadar trik teknisia adalah komponen penting dalam desain sistem inference yang efisien dan scalable.

Kalau kamu ingin menjalankan inference lebih cepat dan lebih hemat memori, TurboQuant KV cache compression patut masuk radar.

Dengan memahami konsep KV cache, menilai trade-off kualitas, dan melakukan pengujian berbasis metrik, kamu bisa memanfaatkan context window lebih optimal untuk kebutuhan aplikasi kamutanpa harus selalu bergantung pada upgrade hardware yang mahal.

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)