Tips Praktis Membangun Semantic Search dengan LLM Embeddings

VOXBLICK.COM - Bayangkan kamu sedang mencari sebuah dokumen penting di antara ribuan file digital, tapi hasil pencarian selalu saja memunculkan hal yang tidak relevan. Rasanya pasti melelahkan, bukan? Padahal, teknologi sudah berkembang, dan kini ada cara yang jauh lebih cerdas agar mesin benar-benar “mengerti” maksud pencarianmu. Yup, inilah saatnya mengenal semantic search dengan LLM embeddings! Dengan teknologi ini, kamu bisa membangun sistem pencarian yang memahami makna, bukan sekadar mencocokkan kata kunci.

Kalau kamu penasaran bagaimana cara praktis membangun semantic search yang powerfultanpa harus pusing dengan teori beratyuk simak langkah-langkah dan tips berikut. Siap-siap, pengalaman pencarianmu bakal naik level!

Mengenal Singkat Semantic Search dan LLM Embeddings

Sebelum kita masuk ke tips-tipsnya, kamu perlu tahu dulu apa itu semantic search dan LLM embeddings.

Singkatnya, semantic search adalah metode pencarian yang memahami konteks dan makna, bukan sekadar mencari kata kunci. Sementara itu, Large Language Model (LLM) embeddings adalah representasi vektor dari kata, kalimat, atau dokumen yang dihasilkan oleh model berbasis AI seperti BERT atau GPT. Dengan embeddings ini, mesin bisa “mengukur” seberapa mirip makna antar teks.

Langkah-Langkah Praktis Membangun Semantic Search

Langkah-langkah berikut bisa kamu praktikkan langsung, bahkan jika kamu belum terlalu akrab dengan istilah teknis seputar AI!

-

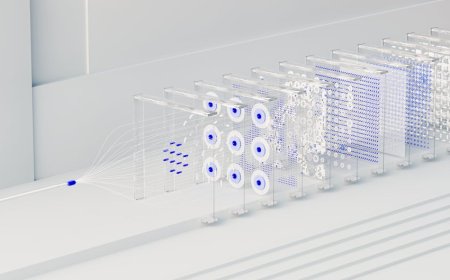

Pilih Model Embeddings yang Sesuai

LLM embeddings ada banyak jenisnya, seperti OpenAI (ada model text-embedding-ada-002), Sentence Transformers (SBERT), atau BERT. Jika kamu baru mencoba, mulai saja dari Sentence Transformers yang open source dan mudah diintegrasikan ke berbagai bahasa pemrograman. -

Buat Representasi Embeddings dari Data

Ubah semua dokumen, artikel, atau konten yang ingin kamu cari menjadi bentuk embeddings (vektor). Proses ini biasanya otomatis lewat script sederhana, misalnya menggunakan Python dan librarysentence-transformers. -

Simpan Embeddings dalam Database yang Tepat

Setelah semua data diubah jadi embeddings, simpan ke database yang mendukung pencarian vektor, seperti Pinecone, Weaviate, atau FAISS. Ini penting supaya pencarian nanti bisa dilakukan dengan sangat cepat dan efisien. -

Proses Query Pengguna Menjadi Embeddings

Saat ada yang mencari sesuatu, kalimat pencarian (query) juga diubah dulu jadi embeddings. Dengan begitu, kamu bisa membandingkan vektor query dengan vektor dokumen untuk menemukan hasil yang paling relevan secara makna. -

Gunakan Similarity Search untuk Menemukan Hasil Terbaik

Bandingkan embeddings query dengan embeddings data menggunakan cosine similarity atau dot product. Hasil pencarian akan diurutkan berdasarkan kemiripannya, sehingga pengguna mendapatkan hasil yang benar-benar relevan.

Tips Jitu agar Semantic Search-mu Lebih Maksimal

Biar hasilnya makin mantap dan user experience makin kece, coba ikuti beberapa tips berikut:

-

Selalu Update Model Embeddings

Model LLM terus berkembang. Rajin-rajinlah cek update terbaru agar hasil pencarian tetap akurat dan relevan. -

Perhatikan Bahasa dan Konteks Lokal

Jika pengguna banyak yang menggunakan bahasa Indonesia atau bahasa campuran, gunakan model embeddings yang mendukung bahasa tersebut. Ini bisa meningkatkan relevansi hasil pencarian. -

Test dengan Data Nyata

Uji semantic search-mu dengan data dan query nyata dari pengguna. Evaluasi hasilnya dan lakukan penyesuaian jika diperlukan. -

Berikan Fitur Feedback

Izinkan pengguna memberikan feedback atas hasil pencarian. Ini akan membantumu memperbaiki sistem dan menyesuaikan dengan kebutuhan user. -

Optimalkan Kecepatan Pencarian

Pilih database vektor yang sesuai dengan kebutuhan dan skalabilitas sistemmu. Untuk skala kecil, FAISS bisa jadi solusi simpel. Untuk trafik besar, Pinecone atau Weaviate patut dicoba.

Upgrade Pengalaman Pencarian dengan Semantic Search

Membangun semantic search dengan LLM embeddings terdengar rumit, tapi dengan langkah dan tips praktis di atas, kamu sudah selangkah lebih dekat ke sistem pencarian yang benar-benar paham kebutuhan pengguna.

Mulailah dengan model sederhana, uji di lingkungan kecil, dan terus tingkatkan sesuai feedback. Hasilnya? Pencarian yang lebih cerdas, relevan, dan pastinya bikin pengguna betah!

Jangan ragu untuk bereksperimen. Siapa tahu, project-mu berikutnya jadi solusi pencarian yang dicari-cari banyak orang!

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)