Tips Praktis Optimalkan KV Caching untuk LLM Supaya Lebih Efisien

VOXBLICK.COM - Bayangkan kamu sedang mengembangkan aplikasi berbasis AI dengan Large Language Model (LLM) favoritmu. Semuanya berjalan lancarsampai proses inferensi mulai melambat dan konsumsi memori membengkak. Nah, salah satu kunci agar LLM tetap gesit dan hemat sumber daya adalah dengan mengoptimalkan KV (Key-Value) caching. Walaupun terdengar teknis, mengelola KV caching sebenarnya bisa dilakukan dengan trik-trik praktis yang mudah kamu terapkan. Yuk, simak langkah-langkahnya supaya workflow AI-mu makin efisien dan performa model jadi maksimal!

Mengapa KV Caching Penting untuk LLM?

Sebelum masuk ke cara optimasi, penting banget untuk tahu mengapa KV caching punya peran sentral dalam inference LLM. KV cache menyimpan hasil intermediate (key dan value pada attention mechanism) dari token-token sebelumnya saat model bekerja.

Dengan cache yang optimal, proses prediksi token berikutnya jadi jauh lebih cepat dan hemat memori, terutama saat menangani sequence panjang. Artinya, kamu bisa menghemat waktu, uang, dan energi server!

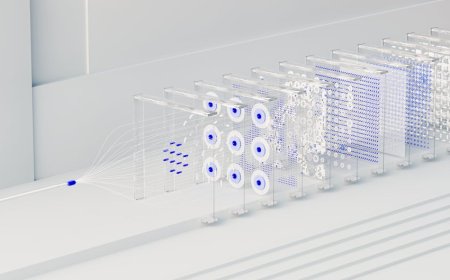

Langkah-Langkah Praktis Optimalkan KV Caching pada LLM

Kamu nggak perlu jadi engineer super untuk menerapkan tips berikut. Cukup beberapa langkah sederhana, dan hasilnya bisa langsung kamu rasakan pada performa inference LLM!

-

Gunakan Sliding Window untuk Sequence Panjang

Alih-alih menyimpan seluruh key-value untuk setiap token, coba pakai teknik sliding window. Hanya cache bagian sequence yang benar-benar relevan (misal, 128 atau 256 token terakhir). Cara ini mengurangi kebutuhan memori secara drastis tanpa mengorbankan kualitas output. -

Implementasikan Cache Eviction Strategy

KV cache bisa tumbuh besar kalau tidak dibatasi. Terapkan strategi seperti LRU (Least Recently Used) atau TTL (Time-To-Live). Dengan begitu, cache yang sudah lama tidak terpakai akan otomatis dibuang, membuat penggunaan memori jadi lebih efisien. -

Optimalkan Batch Processing

Saat memproses beberapa input sekaligus, pastikan KV caching diatur untuk batch. Hindari duplikasi cache antar batch. Dengan batch-aware cache, kamu bisa memaksimalkan throughput tanpa boros resource. -

Manfaatkan Sharing Cache untuk Repeated Prompts

Kalau kamu sering memproses prompt yang sama (misal, pada chatbot dengan template tertentu), simpan cache prompt tersebut dan gunakan ulang. Ini bisa memangkas waktu inference secara signifikan di setiap request serupa. -

Monitoring dan Profiling Cache Secara Berkala

Jangan lupa cek penggunaan cache secara periodik. Tools profiling (seperti tracing atau logging internal) akan membantumu mendeteksi kebocoran memori atau cache yang tidak pernah dibersihkan. -

Sesuaikan Ukuran Cache dengan Hardware

Jangan terlalu ambisius! Sesuaikan alokasi cache dengan RAM dan VRAM yang tersedia. Lakukan benchmark kecil-kecilan untuk menemukan sweet spot antara kecepatan dan pemakaian memori.

Tips Bonus: Jangan Lupakan Optimasi di Layer Aplikasi

Selain mengatur KV cache di level model, kamu juga bisa melakukan optimasi di aplikasi. Misalnya, gunakan endpoint inference yang asinkron agar proses tidak menumpuk, atau queue request agar tidak terjadi spike penggunaan resource.

Semua ini berkontribusi pada KV caching yang lebih sehat dan efisien.

Inspirasi Praktis: Workflow KV Caching yang Efektif

Kunci sukses optimasi KV caching pada LLM terletak pada konsistensi. Cobalah buat checklist sederhana seperti berikut:

- Evaluasi kebutuhan cache sebelum deploy aplikasi AI-mu.

- Rutin update dan pantau strategi cache sesuai skala pengguna.

- Diskusikan dengan tim jika ingin mengadopsi teknik baru, seperti distributed KV cache untuk deployment skala besar.

- Catat setiap perubahan performa dan lakukan iterasi sampai menemukan konfigurasi yang pas.

Pada akhirnya, dengan menerapkan tips-tips praktis di atas, kamu bisa merasakan langsung manfaat KV caching yang optimal pada LLM.

Proses inference jadi lebih cepat, resource server jauh lebih hemat, dan pengalaman pengguna aplikasi AI-mu pun makin mulus. Selamat mencoba dan eksplorasi lebih jauh, karena setiap langkah kecil dalam optimasi bisa membawa perubahan besar dalam performa AI-mu!

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)