Top 5 Reranking Models untuk Hasil RAG Lebih Akurat

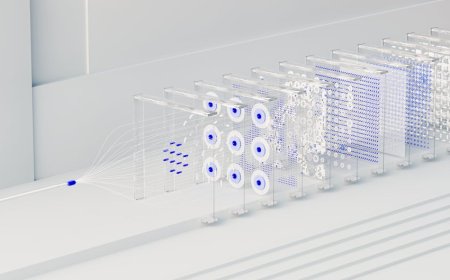

VOXBLICK.COM - Kalau kamu pernah mencoba RAG (Retrieval-Augmented Generation) tapi hasilnya terasa “nggak nyambung”, biasanya bukan karena model generatifnya jelekmelainkan karena tahap retrieval masih membawa terlalu banyak dokumen yang hanya sebagian relevan. Nah, di sinilah reranking berperan. Reranking model akan menilai ulang kandidat dokumen yang sudah diambil, lalu menyaring mana yang paling cocok untuk pertanyaanmu. Hasilnya? Jawaban RAG jadi lebih akurat, lebih fokus, dan gangguan informasi (noise) berkurang.

Dalam panduan ini, kamu akan mempelajari Top 5 reranking models yang populer dan terbukti efektif untuk meningkatkan kualitas RAG.

Kamu juga akan paham cara kerja reranker menyortir dokumen relevan, bagaimana memilih parameter seperti top-k, serta kapan sebaiknya kamu mengutak-atik konfigurasi agar performa makin stabil.

Kenapa Reranking Itu Penting untuk RAG?

RAG umumnya punya dua langkah besar: (1) mengambil dokumen dari basis pengetahuan, dan (2) menggunakan dokumen tersebut untuk menghasilkan jawaban.

Masalah yang sering muncul: retrieval berbasis embedding atau keyword tidak selalu menangkap konteks halus. Akibatnya, kamu bisa mendapatkan dokumen yang mirip secara permukaan, tapi sebenarnya tidak menjawab pertanyaan.

Reranker mengatasi ini dengan cara:

- Menghitung ulang relevansi antara query dan kandidat dokumen, biasanya dengan model cross-encoder atau model yang lebih “paham konteks”.

- Menyusun ulang urutan dokumen (ranking), sehingga dokumen yang lebih tepat muncul di posisi teratas.

- Mengurangi noise karena dokumen yang kurang relevan bisa dibuang sebelum masuk ke konteks prompt.

Kalau kamu ingin hasil RAG lebih akurat, reranking adalah salah satu “tombol” paling berdampaksering kali lebih terasa dibanding sekadar mengganti generator.

Model Reranking #1: Cross-Encoder dari keluarga BERT (mis. BERT-based Cross-Encoder)

Model reranking berbasis cross-encoder (sering keluarga BERT atau varian sejenis) biasanya menjadi fondasi yang kuat.

Cross-encoder bekerja dengan cara memasangkan query dan teks dokumen secara bersamaan, lalu model menilai skor relevansi berdasarkan interaksi token-token keduanya.

Kelebihan:

- Biasanya akurasi reranking tinggi karena model “melihat” hubungan langsung query-dokumen.

- Cocok untuk kebutuhan RAG yang butuh ketelitian semantik.

Catatan praktis: cross-encoder umumnya lebih mahal secara komputasi dibanding bi-encoder. Karena itu, kamu biasanya menjalankan reranker pada kandidat hasil retrieval awal, bukan pada seluruh korpus.

Tips parameter: mulai dari top-k hasil retrieval misalnya 20–50, lalu rerank dan ambil top 3–10 dokumen untuk konteks generator. Kamu bisa menyesuaikan sesuai panjang dokumen dan batas konteks LLM.

Model Reranking #2: MonoT5 (T5-based Reranker)

MonoT5 adalah pendekatan reranking berbasis sequence-to-sequence (keluarga T5) yang dirancang untuk menilai pasangan (query, dokumen).

Ia sering dipakai karena mampu menangkap hubungan relevansi yang lebih kompleks, terutama untuk tugas retrieval yang mengandung nuansa bahasa.

Kelebihan:

- Bagus untuk reranking berbasis pemahaman bahasa (language understanding).

- Performa sering stabil pada domain umum maupun domain teknis, selama data pelatihannya relevan.

Kapan kamu cocok pakai MonoT5? Jika jawaban RAGmu sering “nyasar” karena dokumen yang mirip secara embedding ternyata tidak menjawab aspek spesifik pertanyaan, MonoT5 cenderung lebih mampu menyaringnya.

Tips implementasi cepat: pastikan format input konsisten (misalnya query diperlakukan sebagai “source” dan dokumen sebagai “target” sesuai kebutuhan model). Lalu, lakukan reranking pada kandidat terbatas agar latency tetap terkendali.

Model Reranking #3: Cohere Rerank (API-hosted Reranker)

Kalau kamu ingin hasil cepat tanpa repot tuning model sendiri, Cohere Rerank (reranker berbasis API) sering jadi pilihan praktis.

Model ini dirancang khusus untuk ranking relevansi dan biasanya memberikan peningkatan kualitas yang terasa pada pipeline RAG.

Keunggulan utama:

- Waktu implementasi cepatkamu tinggal integrasikan ke pipeline retrieval + reranking.

- Biasanya performa konsisten tanpa banyak tuning.

- Memudahkan scaling karena komputasi ditangani oleh penyedia.

Namun, perhatikan: biaya per query dan batasan panjang input. Untuk dokumen panjang, kamu sebaiknya melakukan chunking atau ambil cuplikan yang paling mungkin relevan sebelum masuk ke reranker.

Rekomendasi top-k: sering kali kombinasi “retrieval top 25–50 + rerank top 5–8” adalah titik awal yang bagus untuk menyeimbangkan kualitas dan biaya.

Model Reranking #4: bge-reranker (mis. bge-reranker-large / bge-reranker-base)

bge-reranker merupakan keluarga reranker yang populer karena performanya kompetitif dan relatif efisien. Model ini biasanya mendukung reranking yang kuat untuk berbagai bahasa dan domain, tergantung versi yang kamu gunakan.

Kelebihan:

- Sering memberikan peningkatan kualitas pada RAG tanpa perlu kerja ekstra.

- Lebih “ringan” dibanding beberapa reranker cross-encoder yang sangat berat (tergantung ukuran versinya).

Strategi yang biasanya bekerja:

- Gunakan retriever embedding (bi-encoder) untuk mengambil kandidat awal.

- Masukkan kandidat tersebut ke bge-reranker untuk urutan final.

- Pilih dokumen top 3–6 untuk konteks prompt agar LLM tidak kebanyakan membaca informasi yang tidak diperlukan.

Dengan pendekatan ini, kamu mengurangi risiko “jawaban terdistraksi” karena konteks prompt berisi materi yang kurang relevan.

Model Reranking #5: LLM-as-a-Judge Reranking (berbasis model generatif)

Ini bukan reranker tradisional cross-encoder, tapi strategi yang semakin sering dipakai: menjadikan sebuah LLM sebagai judge untuk menilai relevansi query-dokumen.

Caranya bisa berupa scoring berbasis kriteria, atau meminta model menentukan “seberapa relevan” dokumen terhadap pertanyaan.

Kelebihan:

- Sangat fleksibel: kamu bisa masukkan kriteria penilaian yang spesifik, misalnya “jawab langsung pertanyaan” atau “mengandung langkah-langkah implementasi”.

- Cocok untuk kebutuhan reranking yang kompleks, seperti domain hukum, medis, atau instruksi teknis.

Kekurangan yang perlu kamu waspadai: biaya dan latency bisa naik, dan konsistensi skor kadang perlu kalibrasi. Karena itu, strategi ini biasanya dipakai pada kandidat yang sudah dipersempit (misalnya top 10) agar tetap efisien.

Tips implementasi: gunakan format prompt yang ketat dan minta output skor numerik (misalnya 0–100) plus alasan singkat. Lalu, lakukan reranking berdasarkan skor tersebut.

Cara Memilih top-k yang Efektif (Agar RAG Makin Akurat)

Top-k itu seperti “jumlah kandidat yang kamu beri kesempatan”. Kalau terlalu kecil, kamu berisiko melewatkan dokumen yang sebenarnya relevan. Kalau terlalu besar, reranker harus bekerja keras dan konteks prompt jadi penuh noise.

Kamu bisa pakai pendekatan sederhana berikut:

- Retrieval top-k (awal): 20–50 kandidat. Ini memberi ruang reranker untuk memilih yang terbaik.

- Rerank top-k (untuk konteks): 3–10 dokumen. Untuk LLM dengan context window terbatas, mulailah dari 3–6.

- Uji bertahap: coba top-k rerank 3, 5, lalu 8. Lihat kualitas jawaban dan tingkat “halusinasi” atau jawaban nyasar.

Selain top-k, kamu juga bisa mengatur panjang chunk. Untuk reranking, dokumen yang terlalu panjang kadang membuat penilaian kurang fokus. Chunk yang lebih spesifik (misalnya paragraf atau bagian yang relevan) sering membantu.

Checklist Praktis Agar Reranking Berhasil di RAG

- Pastikan chunking rapi: pecah dokumen berdasarkan topik/struktur, bukan sekadar panjang karakter.

- Gunakan reranker pada kandidat terbatas: jangan rerank seluruh korpus.

- Kalibrasi top-k dan panjang konteks: kualitas reranking biasanya paling terasa saat konteks prompt tidak kebanyakan.

- Evaluasi dengan metrik yang relevan: misalnya hit rate dokumen relevan, kualitas jawaban, atau human evaluation.

- Perhatikan bahasa dan domain: pilih model reranker yang paling cocok untuk gaya bahasa data kamu.

Rekomendasi Pemilihan Model Berdasarkan Kebutuhanmu

Kalau kamu ingin keputusan yang cepat:

- Mau akurasi tinggi dengan setup teknis: coba cross-encoder BERT-based atau bge-reranker.

- Mau reranking yang kuat untuk nuansa bahasa: MonoT5 bisa jadi opsi menarik.

- Mau implementasi cepat dan konsisten: Cohere Rerank (API) sering paling praktis.

- Mau kontrol kriteria penilaian yang detail: LLM-as-a-judge cocok, terutama untuk kandidat kecil.

Pada akhirnya, “model terbaik” adalah yang paling sesuai dengan trade-off akurasi vs latency vs biaya di pipeline RAG kamu.

Yang pasti, dengan reranking yang tepat dan konfigurasi top-k yang waras, kamu akan melihat perbedaan: dokumen relevan lebih sering masuk konteks, noise berkurang, dan jawaban jadi lebih presisi terhadap pertanyaan.

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)