Ternyata Ada Bias dari AI yang Bisa Ancam dan Rugikan Masa Depan Kita!

VOXBLICK.COM - Kecanggihan teknologi Artificial Intelligence (AI) atau kecerdasan buatan telah merambah berbagai aspek kehidupan, menjanjikan efisiensi dan inovasi. Namun, di balik kemudahan dan potensi yang ditawarkan, tersembunyi sebuah ancaman laten: bias algoritma. Bias ini, jika tidak diatasi dengan serius, berpotensi menjadi "senjata makan tuan" yang memperburuk ketidaksetaraan dan merugikan kelompok-kelompok tertentu dalam masyarakat. Bias algoritma, atau algorithmic bias, adalah fenomena di mana sistem AI menghasilkan hasil yang secara sistematis tidak adil atau diskriminatif terhadap kelompok tertentu. Hal ini bisa terjadi karena berbagai faktor, termasuk data pelatihan yang bias, desain algoritma yang bias, atau bahkan interpretasi hasil yang bias. Konsekuensi dari bias algoritma bisa sangat luas, mulai dari diskriminasi dalam pinjaman dan pekerjaan hingga ketidakadilan dalam sistem peradilan pidana. Untuk memahami lebih lanjut tentang bias algoritma, Anda dapat mengunjungi Wikipedia tentang Algorithmic Bias.

Memahami Bias dalam Algoritma AI

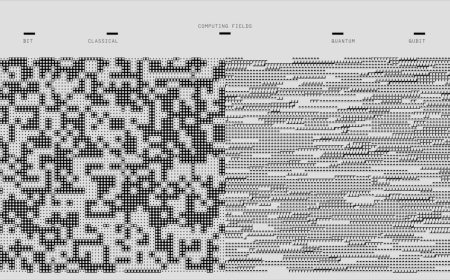

Bias dalam algoritma AI muncul ketika data yang digunakan untuk melatih sistem AI tersebut tidak representatif atau mencerminkan prasangka yang sudah ada. Algoritma, pada dasarnya, belajar dari data. Jika data tersebut bias, maka output atau keputusan yang dihasilkan oleh AI juga akan bias. Hal ini dapat terjadi tanpa disadari oleh pengembang AI, namun dampaknya bisa sangat signifikan. Misalnya, jika sebuah algoritma dilatih untuk mendeteksi wajah manusia hanya menggunakan gambar wajah orang kulit putih, maka algoritma tersebut mungkin kesulitan atau bahkan gagal mendeteksi wajah orang dengan warna kulit yang berbeda. Hal ini dapat menyebabkan masalah serius dalam aplikasi seperti pengenalan wajah dan keamanan. Lebih jauh lagi, bias ini bisa diperkuat seiring waktu jika algoritma terus dilatih dengan data yang bias. Untuk contoh kasus bias algoritma, lihat artikel ProPublica tentang bias dalam penilaian risiko kejahatan.

Sumber-Sumber Bias dalam AI

Beberapa sumber bias dalam AI meliputi:

Data pelatihan yang tidak representatif: Jika data yang digunakan untuk melatih AI tidak mencerminkan keragaman populasi yang sebenarnya, maka AI akan cenderung membuat keputusan yang bias terhadap kelompok mayoritas. Misalnya, dalam pengembangan sistem pengenalan suara, jika data pelatihan didominasi oleh suara laki-laki, sistem tersebut mungkin kurang akurat dalam mengenali suara perempuan. Ini adalah contoh klasik dari bagaimana kurangnya representasi dalam data pelatihan dapat menyebabkan bias algoritma. Penting untuk memastikan bahwa data pelatihan mencakup berbagai kelompok demografis, aksen, dan gaya bicara. Selain itu, data sintetik dapat digunakan untuk menambah data pelatihan dan mengatasi kekurangan representasi.

Prasangka dalam data: Data historis seringkali mencerminkan prasangka sosial yang sudah ada. Jika AI dilatih dengan data seperti ini, maka ia akan mempelajari dan mereproduksi prasangka tersebut. Contohnya, data historis tentang pinjaman mungkin menunjukkan bahwa perempuan lebih jarang membayar pinjaman tepat waktu dibandingkan laki-laki. Jika AI dilatih dengan data ini, ia mungkin akan cenderung menolak permohonan pinjaman dari perempuan, bahkan jika mereka sebenarnya memenuhi syarat. Prasangka ini mencerminkan stereotip gender yang sudah ada dan dapat diperkuat oleh AI. Untuk mengatasi masalah ini, penting untuk membersihkan data dari prasangka sebelum digunakan untuk melatih AI.

Desain algoritma yang bias: Algoritma itu sendiri dapat dirancang dengan cara yang bias, misalnya dengan memberikan bobot yang berbeda pada fitur-fitur tertentu yang relevan dengan kelompok tertentu. Misalnya, dalam sistem penilaian kredit, algoritma mungkin memberikan bobot yang lebih tinggi pada faktor-faktor yang lebih umum pada kelompok mayoritas, seperti kepemilikan rumah atau riwayat kredit yang panjang. Hal ini dapat merugikan kelompok minoritas yang mungkin memiliki riwayat kredit yang lebih pendek atau tidak memiliki rumah. Desainer algoritma harus sadar akan potensi bias dan mengambil langkah-langkah untuk meminimalkannya. Ini termasuk menggunakan teknik seperti fairness-aware machine learning dan differential privacy. Untuk lebih memahami tentang fairness-aware machine learning, kunjungi Google AI Fairness.

Dampak Bias Algoritma dalam Kehidupan Sehari-hari

Bias algoritma tidak hanya menjadi masalah teoretis. Dampaknya dapat dirasakan dalam berbagai aspek kehidupan sehari-hari, mulai dari sistem peradilan hingga layanan kesehatan.

Dampak ini seringkali tidak terlihat, tetapi dapat memiliki konsekuensi yang signifikan bagi individu dan masyarakat secara keseluruhan. Penting untuk meningkatkan kesadaran tentang dampak bias algoritma dan mengambil langkah-langkah untuk memitigasinya.

Diskriminasi dalam Sistem Peradilan

Sistem peradilan pidana semakin mengandalkan AI untuk membantu dalam pengambilan keputusan, seperti menentukan risiko residivisme (kemungkinan pelaku melakukan kejahatan lagi). Namun, penelitian telah menunjukkan bahwa algoritma yang digunakan dalam sistem ini seringkali bias terhadap kelompok minoritas, sehingga meningkatkan kemungkinan mereka dihukum lebih berat. Misalnya, algoritma COMPAS, yang digunakan di beberapa negara bagian di Amerika Serikat, telah terbukti secara tidak proporsional mengklasifikasikan orang kulit hitam sebagai berisiko tinggi untuk melakukan kejahatan di masa depan. Hal ini dapat menyebabkan mereka ditolak pembebasan bersyarat atau menerima hukuman yang lebih berat. Diskriminasi ini dapat memperburuk ketidaksetaraan rasial dalam sistem peradilan pidana. Untuk informasi lebih lanjut tentang COMPAS, lihat Electronic Frontier Foundation tentang penilaian risiko algoritmik.

Ketidaksetaraan dalam Layanan Kesehatan

AI juga digunakan dalam layanan kesehatan untuk membantu diagnosis penyakit dan merekomendasikan perawatan.

Namun, jika data yang digunakan untuk melatih AI tidak mencerminkan keragaman pasien, maka AI dapat membuat diagnosis yang salah atau merekomendasikan perawatan yang tidak sesuai untuk kelompok-kelompok tertentu. Misalnya, jika algoritma dilatih untuk mendeteksi kanker kulit hanya menggunakan gambar kulit putih, algoritma tersebut mungkin kurang akurat dalam mendeteksi kanker kulit pada orang dengan warna kulit yang lebih gelap. Hal ini dapat menyebabkan diagnosis yang tertunda dan perawatan yang tidak memadai. Penting untuk memastikan bahwa data pelatihan mencakup berbagai jenis kulit dan kondisi medis. Selain itu, dokter dan profesional kesehatan lainnya harus sadar akan potensi bias algoritma dan menggunakan penilaian klinis mereka sendiri untuk melengkapi rekomendasi AI.

Bias dalam Rekrutmen dan Promosi

Perusahaan-perusahaan menggunakan AI untuk menyaring lamaran pekerjaan dan mengidentifikasi kandidat yang potensial. Namun, algoritma ini dapat bias terhadap kelompok-kelompok tertentu, seperti perempuan atau minoritas, sehingga menghambat peluang mereka untuk mendapatkan pekerjaan atau promosi. Misalnya, algoritma yang dilatih dengan data historis tentang karyawan yang sukses mungkin secara tidak sadar memprioritaskan kandidat yang memiliki karakteristik yang sama dengan karyawan tersebut, seperti jenis kelamin, ras, atau latar belakang pendidikan. Hal ini dapat menyebabkan kurangnya keragaman di tempat kerja dan menghambat kemajuan karir bagi kelompok-kelompok tertentu. Perusahaan harus secara aktif memantau dan mengatasi bias dalam algoritma rekrutmen mereka dan memastikan bahwa mereka memberikan kesempatan yang sama kepada semua kandidat. Implementasi blind resume dan penggunaan metrik yang lebih objektif dapat membantu mengurangi bias. Untuk informasi lebih lanjut tentang bias dalam rekrutmen AI, kunjungi Harvard Business Review tentang algoritma perekrutan yang diskriminatif.

Mengatasi Bias Algoritma: Tantangan dan Solusi

Mengatasi bias algoritma bukanlah tugas yang mudah. Hal ini membutuhkan upaya multidisiplin yang melibatkan pengembang AI, ilmuwan data, ahli etika, dan pembuat kebijakan.

Tantangan utama adalah mengidentifikasi dan mengukur bias, serta mengembangkan teknik untuk memitigasinya tanpa mengorbankan akurasi atau kinerja. Selain itu, penting untuk membangun kesadaran tentang bias algoritma dan mendorong transparansi dan akuntabilitas dalam pengembangan dan penggunaan AI.

Pentingnya Data yang Representatif dan Diversifikasi Tim

Salah satu langkah penting adalah memastikan bahwa data yang digunakan untuk melatih AI representatif dan mencerminkan keragaman populasi yang sebenarnya.

Selain itu, penting untuk memiliki tim pengembang AI yang beragam, sehingga berbagai perspektif dapat dipertimbangkan dalam desain dan pengembangan algoritma. Diversifikasi tim tidak hanya membantu mengidentifikasi potensi bias, tetapi juga membawa ide-ide baru dan perspektif yang berbeda yang dapat meningkatkan kualitas dan efektivitas AI. Perusahaan harus berinvestasi dalam program pelatihan dan pengembangan untuk meningkatkan kesadaran tentang bias dan mempromosikan inklusi dan kesetaraan dalam tim mereka. Selain itu, kolaborasi dengan kelompok masyarakat dan organisasi advokasi dapat membantu memastikan bahwa AI dikembangkan dan digunakan secara adil dan bertanggung jawab.

Audit Algoritma dan Transparansi

Audit algoritma secara berkala dapat membantu mengidentifikasi dan memperbaiki bias yang mungkin ada. Transparansi dalam pengembangan dan penggunaan AI juga penting, sehingga publik dapat memahami bagaimana algoritma bekerja dan bagaimana keputusan dibuat. Audit algoritma harus dilakukan oleh pihak ketiga yang independen dan harus mencakup evaluasi data pelatihan, desain algoritma, dan output yang dihasilkan. Hasil audit harus dipublikasikan secara transparan, sehingga publik dapat memahami potensi bias dan dampaknya. Transparansi juga penting dalam pengembangan AI, sehingga pengembang dapat menjelaskan bagaimana algoritma mereka bekerja dan bagaimana mereka telah mengambil langkah-langkah untuk memitigasi bias. Hal ini dapat membantu membangun kepercayaan publik dan mendorong akuntabilitas. Untuk panduan tentang audit algoritma, lihat Brookings tentang cara mengaudit algoritma.

Regulasi dan Etika AI

Pemerintah dan organisasi internasional perlu mengembangkan regulasi dan pedoman etika yang jelas untuk pengembangan dan penggunaan AI. Regulasi ini harus memastikan bahwa AI digunakan secara adil dan bertanggung jawab, serta melindungi hak-hak individu. Regulasi harus mencakup persyaratan untuk transparansi, akuntabilitas, dan audit algoritma. Selain itu, regulasi harus melarang penggunaan AI untuk tujuan diskriminatif dan harus memberikan mekanisme bagi individu untuk mengajukan keluhan jika mereka merasa telah didiskriminasi oleh AI. Pedoman etika harus memberikan panduan bagi pengembang AI tentang bagaimana mengembangkan dan menggunakan AI secara bertanggung jawab. Pedoman ini harus mencakup prinsip-prinsip seperti keadilan, transparansi, akuntabilitas, dan penghormatan terhadap hak-hak individu. Uni Eropa telah mengambil langkah-langkah signifikan dalam regulasi AI dengan AI Act.

Peran Literasi Digital dalam Menangkal Dampak Negatif AI

Selain upaya-upaya teknis dan regulasi, literasi digital juga memainkan peran penting dalam menangkal dampak negatif AI.

Masyarakat perlu diedukasi tentang bagaimana AI bekerja, bagaimana bias dapat muncul, dan bagaimana cara mengidentifikasi dan melaporkan diskriminasi yang disebabkan oleh AI. Literasi digital bukan hanya tentang kemampuan menggunakan teknologi, tetapi juga tentang kemampuan untuk memahami dan mengevaluasi informasi yang dihasilkan oleh teknologi.

Membangun Kesadaran Kritis terhadap Informasi

Literasi digital membantu individu untuk mengembangkan kesadaran kritis terhadap informasi yang dihasilkan oleh AI.

Hal ini termasuk kemampuan untuk membedakan antara fakta dan opini, mengidentifikasi sumber-sumber bias, dan mengevaluasi kredibilitas informasi. Dengan meningkatnya jumlah informasi yang dihasilkan oleh AI, penting bagi individu untuk dapat membedakan antara informasi yang akurat dan informasi yang menyesatkan. Literasi digital juga membantu individu untuk memahami bagaimana algoritma bekerja dan bagaimana mereka dapat dipengaruhi oleh bias. Hal ini memungkinkan individu untuk membuat keputusan yang lebih informasi dan menghindari menjadi korban disinformasi atau manipulasi. Selain itu, literasi digital membantu individu untuk memahami implikasi etis dari AI dan untuk berpartisipasi dalam diskusi publik tentang bagaimana AI harus digunakan secara bertanggung jawab.

Partisipasi Aktif dalam Pengembangan AI

Masyarakat juga perlu didorong untuk berpartisipasi aktif dalam pengembangan AI.

Hal ini dapat dilakukan dengan memberikan umpan balik kepada pengembang AI, berpartisipasi dalam diskusi publik tentang etika AI, dan mendukung inisiatif yang bertujuan untuk mengembangkan AI yang adil dan bertanggung jawab. Partisipasi aktif masyarakat dapat membantu memastikan bahwa AI dikembangkan dan digunakan untuk memenuhi kebutuhan dan nilai-nilai masyarakat. Hal ini juga dapat membantu mengidentifikasi dan mengatasi potensi bias dan masalah etika sebelum mereka menjadi masalah yang lebih besar. Selain itu, partisipasi aktif masyarakat dapat membantu membangun kepercayaan publik dalam AI dan mendorong adopsi yang lebih luas. Ini bisa dilakukan melalui forum online, survei, dan kelompok fokus. Pemerintah dan organisasi nirlaba juga dapat memainkan peran penting dalam memfasilitasi partisipasi masyarakat dalam pengembangan AI.

AI dan Poshumanisme: Refleksi Filosofis

Seminar Nasional Seni dan Budaya pada tanggal 28 Oktober 2023 mengangkat tema poshumanisme, sebuah fenomena yang menantang pemikiran kita semua repository.usd.ac.id. Dalam konteks AI, poshumanisme mempertanyakan batasan antara manusia dan mesin, serta implikasi etis dari pengembangan teknologi yang semakin canggih. Apakah AI akan meningkatkan kemampuan manusia, atau justru menggantikan peran manusia dalam masyarakat? Pertanyaan-pertanyaan ini perlu dijawab dengan bijak, dengan mempertimbangkan nilai-nilai kemanusiaan dan keadilan sosial. Poshumanisme mengajak kita untuk merenungkan kembali apa artinya menjadi manusia di era teknologi yang semakin maju. Apakah kita akan merangkul teknologi sebagai alat untuk meningkatkan kemampuan kita, atau apakah kita akan menyerahkan kendali kepada mesin? Diskusi tentang poshumanisme sangat penting untuk memastikan bahwa pengembangan AI selaras dengan nilai-nilai kita dan bahwa teknologi digunakan untuk kebaikan umat manusia. Untuk memahami lebih lanjut tentang poshumanisme, Anda dapat mencari sumber-sumber akademis dan artikel filosofis yang membahas topik ini secara mendalam.

Teknologi Finansial dan Perbankan Digital: Peluang dan Tantangan

Perkembangan teknologi finansial (fintech) dan perbankan digital menawarkan peluang besar untuk meningkatkan efisiensi dan aksesibilitas layanan keuangan. Namun, buku yang membahas topik ini memberikan wawasan bahwa perkembangan ini juga menimbulkan tantangan baru, termasuk risiko keamanan data dan potensi diskriminasi algoritmik digilib.stekom.ac.id. Penting bagi lembaga keuangan dan regulator untuk memastikan bahwa AI digunakan secara bertanggung jawab dalam sektor ini, dengan melindungi hak-hak konsumen dan mencegah praktik-praktik diskriminatif. Lembaga keuangan harus berinvestasi dalam sistem keamanan data yang kuat dan harus mematuhi regulasi privasi data yang ketat. Selain itu, mereka harus secara aktif memantau dan mengatasi bias dalam algoritma mereka dan memastikan bahwa mereka memberikan kesempatan yang sama kepada semua pelanggan. Regulator harus mengembangkan kerangka kerja regulasi yang jelas untuk AI dalam sektor keuangan dan harus menegakkan regulasi ini secara efektif. Kolaborasi antara lembaga keuangan, regulator, dan ahli etika dapat membantu memastikan bahwa AI digunakan secara bertanggung jawab dan berkelanjutan dalam sektor keuangan.

Pengaruh Media dan Perilaku Konsumtif: Studi Kasus Drama Korea

Fenomena budaya populer seperti drama Korea (drakor) juga dapat memberikan wawasan tentang bagaimana teknologi dan media mempengaruhi perilaku manusia. Akses mudah ke tayangan drakor melalui internet telah mengubah perilaku komunikasi anak sekolah dasar repository.uinsaizu.ac.id. Hal ini menunjukkan bahwa teknologi dapat memiliki dampak yang signifikan pada perkembangan sosial dan psikologis individu, terutama pada usia muda. Oleh karena itu, penting bagi orang tua dan pendidik untuk membimbing anak-anak dalam menggunakan teknologi secara bijak dan bertanggung jawab. Orang tua harus memantau penggunaan teknologi anak-anak mereka dan harus menetapkan batasan yang wajar. Mereka juga harus mendorong anak-anak mereka untuk berpartisipasi dalam kegiatan yang tidak melibatkan teknologi, seperti membaca, bermain di luar, dan bersosialisasi dengan teman-teman. Pendidik harus mengintegrasikan literasi digital ke dalam kurikulum dan harus membantu anak-anak mengembangkan keterampilan kritis untuk mengevaluasi informasi yang mereka temukan secara online. Selain itu, mereka harus mengajarkan anak-anak tentang etika digital dan tanggung jawab sosial.

Menuju AI yang Adil dan Berkelanjutan

Bias algoritma merupakan ancaman serius yang dapat memperburuk ketidaksetaraan dan merugikan kelompok-kelompok tertentu dalam masyarakat.

Mengatasi bias ini membutuhkan upaya multidisiplin yang melibatkan pengembang AI, ilmuwan data, ahli etika, pembuat kebijakan, dan masyarakat secara keseluruhan. Dengan memastikan data yang representatif, melakukan audit algoritma secara berkala, mengembangkan regulasi dan pedoman etika yang jelas, serta meningkatkan literasi digital, kita dapat membangun AI yang adil, bertanggung jawab, dan berkelanjutan. Masa depan kita bergantung pada kemampuan kita untuk memanfaatkan potensi AI sambil meminimalkan risiko dan memastikan bahwa teknologi ini digunakan untuk kebaikan semua orang. Untuk mencapai tujuan ini, kita perlu terus berinvestasi dalam penelitian dan pengembangan AI yang etis, mempromosikan transparansi dan akuntabilitas, dan melibatkan masyarakat dalam diskusi tentang bagaimana AI harus digunakan untuk membentuk masa depan yang lebih baik bagi semua. AI yang adil dan berkelanjutan bukan hanya tujuan yang ideal, tetapi juga imperatif moral dan ekonomi. Dengan memastikan bahwa AI digunakan secara adil dan bertanggung jawab, kita dapat membuka potensi penuhnya untuk meningkatkan kehidupan kita dan membangun masyarakat yang lebih inklusif dan sejahtera.

Apa Reaksi Anda?

Suka

0

Suka

0

Tidak Suka

0

Tidak Suka

0

Cinta

0

Cinta

0

Lucu

0

Lucu

0

Marah

0

Marah

0

Sedih

0

Sedih

0

Wow

0

Wow

0

![[VIDEO] Rekor Dunia di Balik Suntikan Polio Massal Pertama Tahun 1955](https://img.youtube.com/vi/8eH0e--DOmU/hqdefault.jpg)